①掌握梯度下降法的优化算法;

②能够使用tf.keras构建Sequential模型,完成多分类任务。

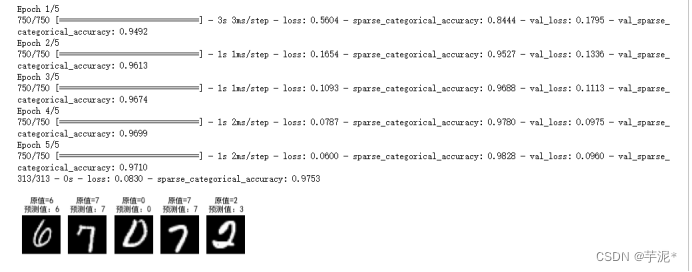

①下载MNIST数据集,建立神经网络模型,实现对MNIST手写数字数据集的识别,调整超参数和训练参数,并以可视化的形式输出模型训练的过程和结果;

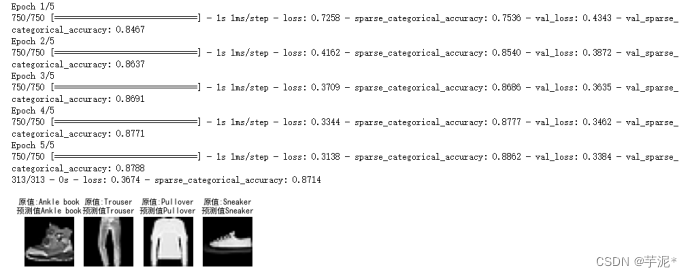

②下载Fashion MNIST数据集,建立神经网络模型,实现对Fashion MNIST数据集的分类,调整超参数和训练参数,并以可视化的形式输出模型训练的过程和结果。

使用神经网络模型,实现对MNIST手写数字数据集的识别,并测试模型性能,记录和分析结果。

要求:

(1)编写代码实现上述功能;

(2)记录实验过程和结果:

调整超参数和训练参数,使模型在测试集达到最优的性能,并以恰当的方式记录和展示实验过程和结果。

(3)分析和总结:

这个模型中的超参数有哪些?训练参数有哪些?结合训练过程,说明它们对模型性能的影响。

(4)保存上述训练好的模型,并使用它对自制的手写数字图像的识别(自制的手写数字图像见期中试题题目二)。

① 代码

② 结果记录

③ 实验总结

使用神经网络模型,实现对Fashion MNIST数据集的分类,并测试模型性能,记录和分析结果。

要求:

(1)编写代码实现上述功能;

(2)记录实验过程和结果:

调整超参数,综合考虑准确率、交叉熵损失、和训练时间等,使模型在测试集达到最优的性能,并以恰当的方式记录和展示实验结果。

(3)分析和总结:

这个模型中的超参数有哪些?简要说明你寻找最佳超参数的过程,并对结果进行分析和总结。

① 代码

② 结果记录

③ 实验总结

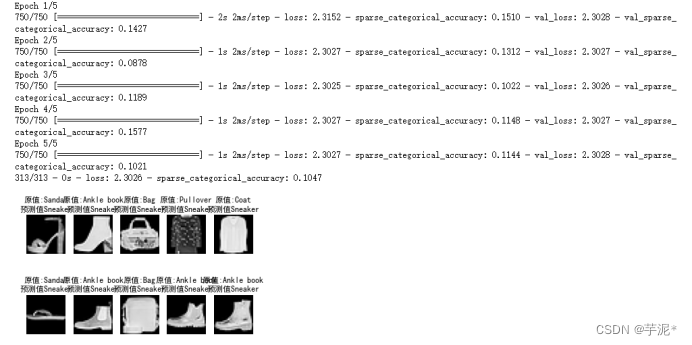

使用低阶API实现Softmax函数和交叉熵损失函数,并使用它们修改题目二。

① 代码

② 实验结果

4.实验小结&讨论题

请结合题目1-3回答下述问题:

①什么是小批量梯度下降法?每个小批量中的样本数对迭代次数有何影响?

答:小批量梯度下降,是对批量梯度下降以及随机梯度下降的一个折中办法。 其思想是:每次迭代 使用 batch_size 个样本来对参数进行更新。在小批量梯度下降法中,每个批中的所有样本共同决定了本次迭代中梯度的方向。

②可以从哪些方面对梯度下降法进行优化?典型的优化方法有哪些?它们对模型训练过程有何影响?

答:从批量大小Batch Size、学习率、梯度估计三个方面进行优化。典型的算法有Momentum-动量、Nesterov-加速梯度下降法、Adagrad-自适应梯度、Adadelta、RMSprop、Adam-自适应矩估计、AdaMax、 Nadam-加速自适应矩估计、Lookahead。

③在设计神经网络时,为MNIST设计的神经网络是否可以直接应用到Fashion-MNIST上?请从数据集的图片大小,样本数以及分类数等角度解释这个现象

答:可以直接使用。Fashion-MNIST 的图片大小,训练、测试样本数及类别数与经典 MNIST完全相同。

④Fashion-MNIST创建之初希望替代MNIST数据集,比较相同的神经网络在这两个数据集上的准确率,并思考在模型评估方面,使用Fashion-MNIST数据集有什么优势?

答:MNIST数据集过于简单,可以在MNIST数据集成功的模型在别的数据集未必可以成功,不具有准确性,而Fashion-MNIST数据集更为复杂,可以更好的训练模型。

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容, 请发送邮件至 举报,一经查实,本站将立刻删除。

如需转载请保留出处:https://bianchenghao.cn/bian-cheng-ri-ji/59233.html