前言

其实啊,无论你是初学者还是具备了有一定spark编程经验,都需要对spark源码足够重视起来。

本人,肺腑之己见,想要成为大数据的大牛和顶尖专家,多结合源码和操练编程。

准备工作

1、scala 2.10.4(本地的安装)

Scala的安装(本地)

2、Jdk1.7+ 或 jdk1.8+ (本地的安装)

Jdk 1.7*安装并配置

Jdk 1.8*安装并配置

JDK的windows和Linux版本之下载

3、IntelliJ IDEA

IntelliJ IDEA(Community版本)的下载、安装和WordCount的初步使用(本地模式和集群模式)

IntelliJ IDEA(Ultimate版本)的下载、安装和WordCount的初步使用(本地模式和集群模式)

Spark源码的编译过程详细解读(各版本)

另外,最后还是建议大家开始先使用 pre-built 的 Spark,对 Spark 的运行、使用方法有所了解,编写了一些 Spark 应用程序后再展开源代码的阅读,并尝试修改源码,进行手动编译。

总体流程

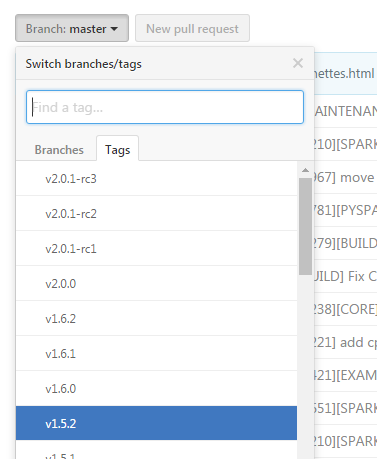

1、从 Github 导入 Spark 工程

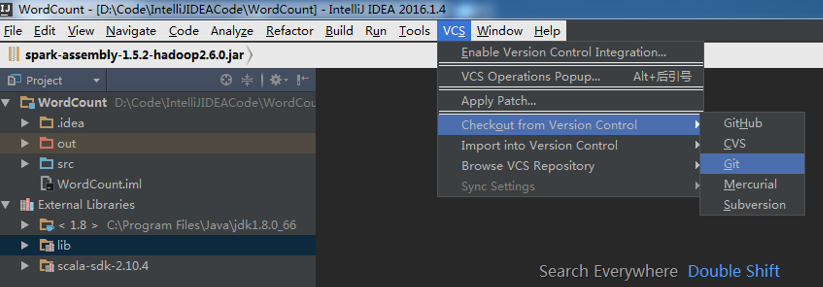

打开IntelliJ IDEA 后,在菜单栏中选择 VCS→Check out from Version Control→Git,之后在 Git Repository URL 中填入 Spark 项目的地址,并指定好本地路径,如下图所示。

https://github.com/apache/spark.git

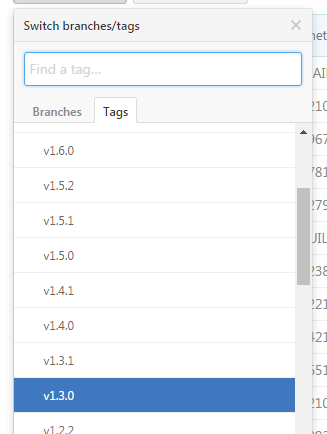

或者,我们可以直接先下载好,

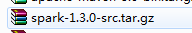

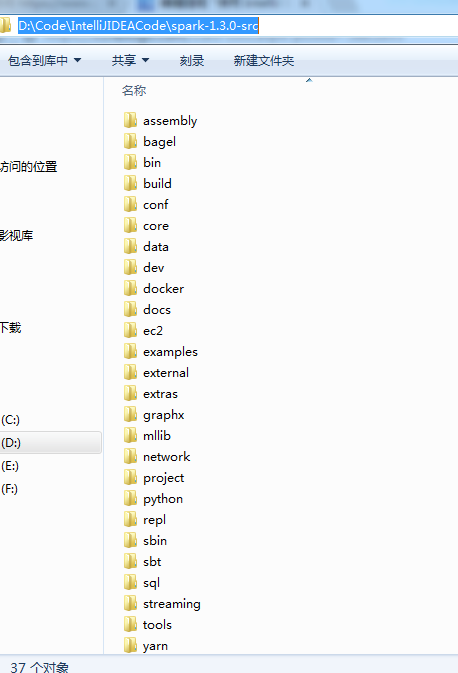

比如我这里,已经下载好了

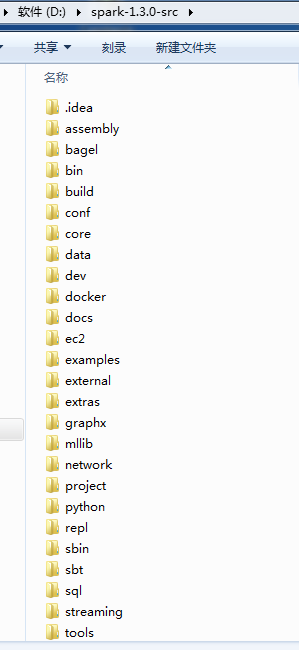

解压,

提前,先准备好

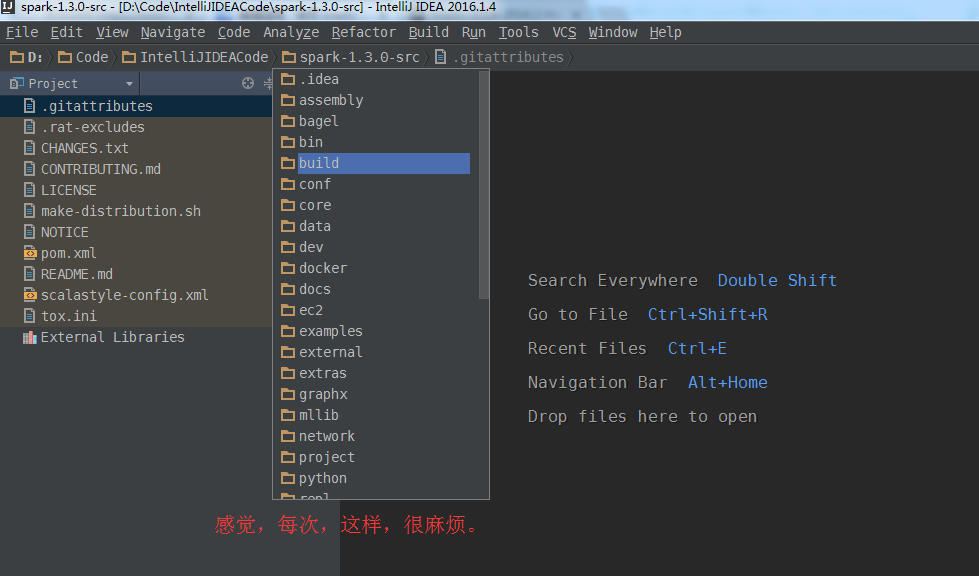

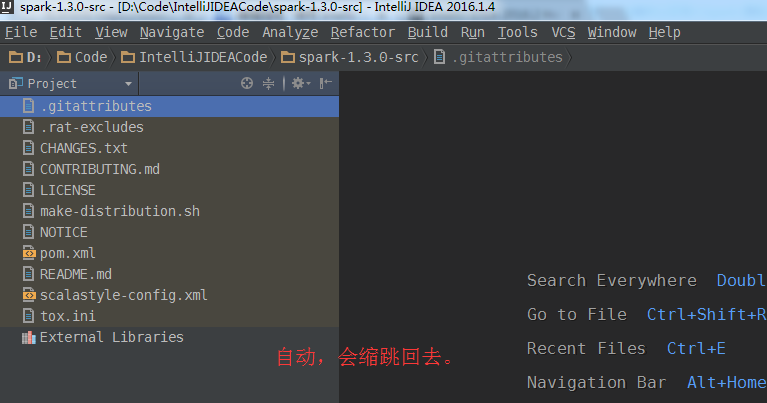

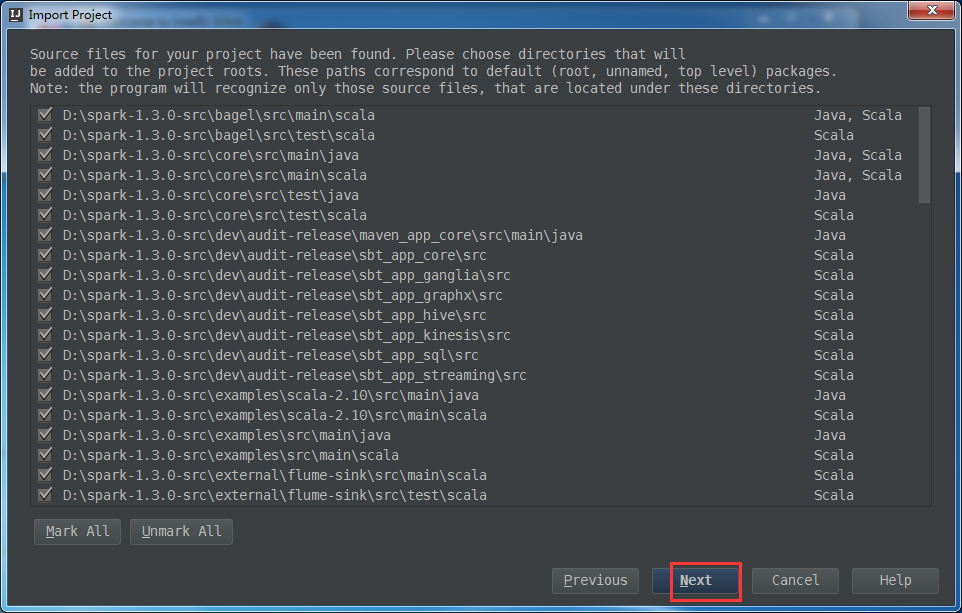

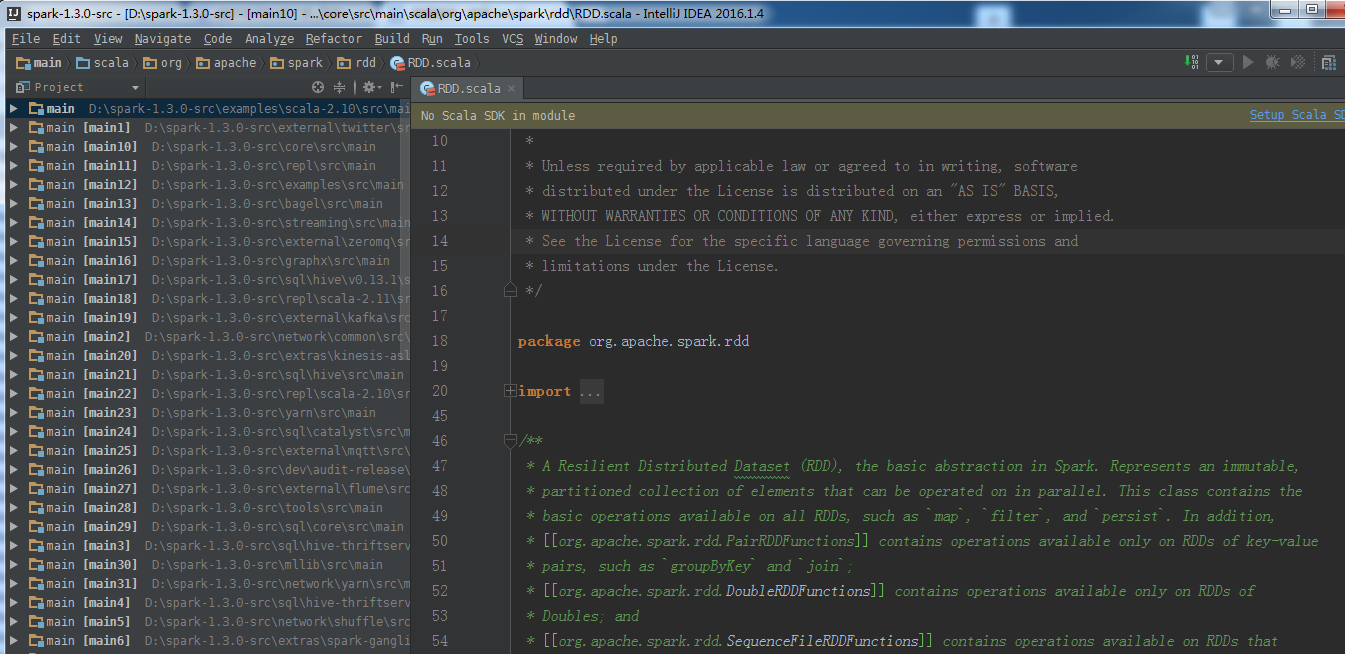

对于spark源码的目录结构

1、编译相关 : sbt 、assembly、project

2、spark核心 :core

3、Spark Lib : streaming 、 sql 、graphx 、mllib

4、运行脚本和配置 : bin 、sbin 、conf

5、虚拟化 : ec2 、docker 、dev

6、式例 : examples 、data

7、部署相关: yarn

8、python支持 idea导入不了SparkContext包 : python

9、repl : repl

10、 3pp : externals

现在,我开始,进入spark源码导入工作。

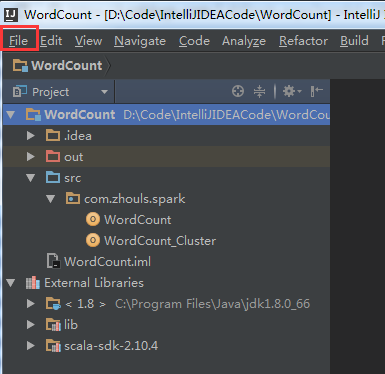

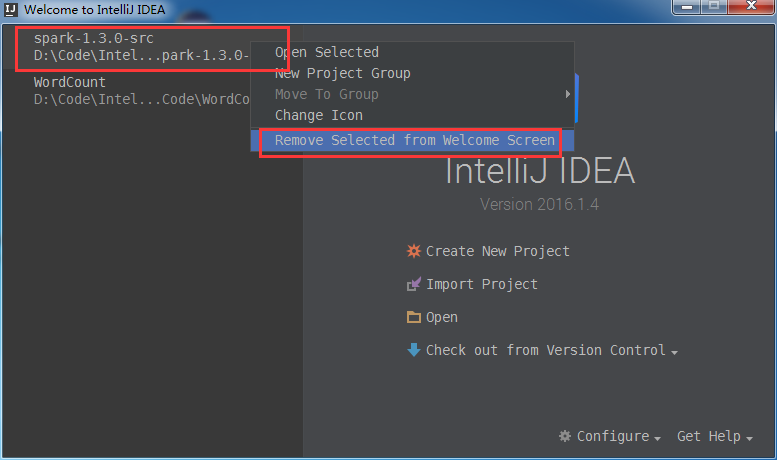

先来关闭,已有的工程。

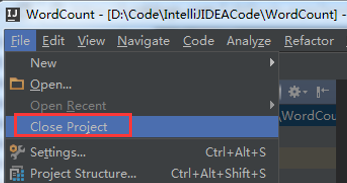

File -> Close Project

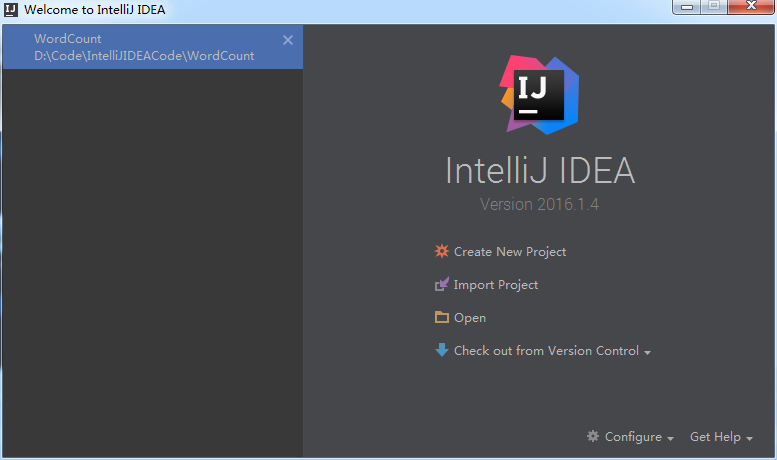

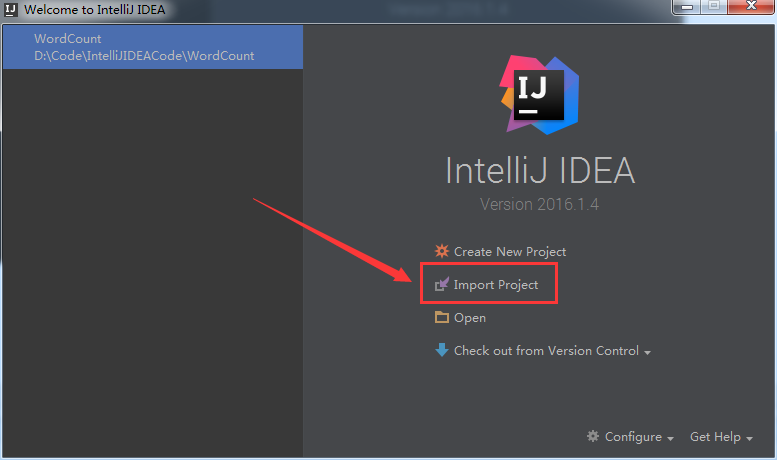

得到,如下

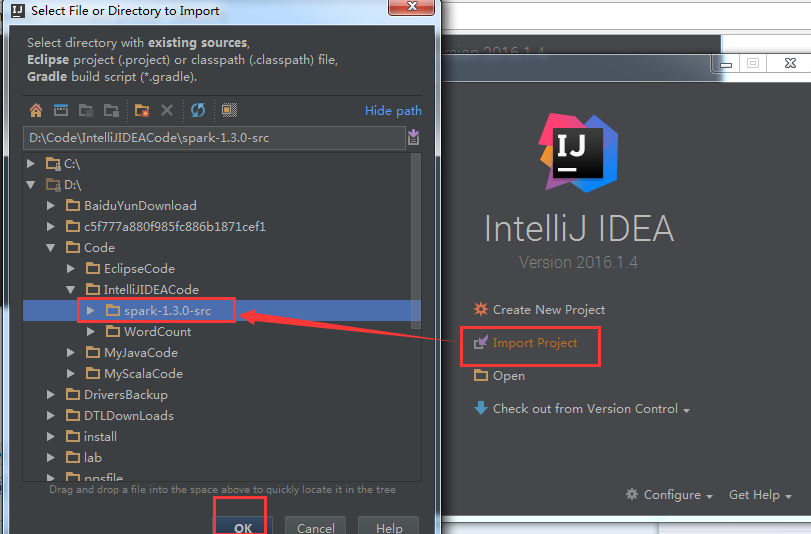

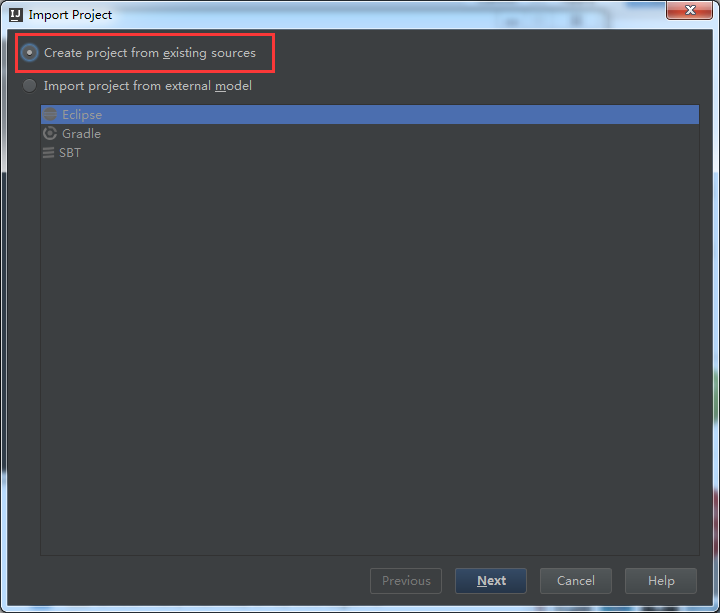

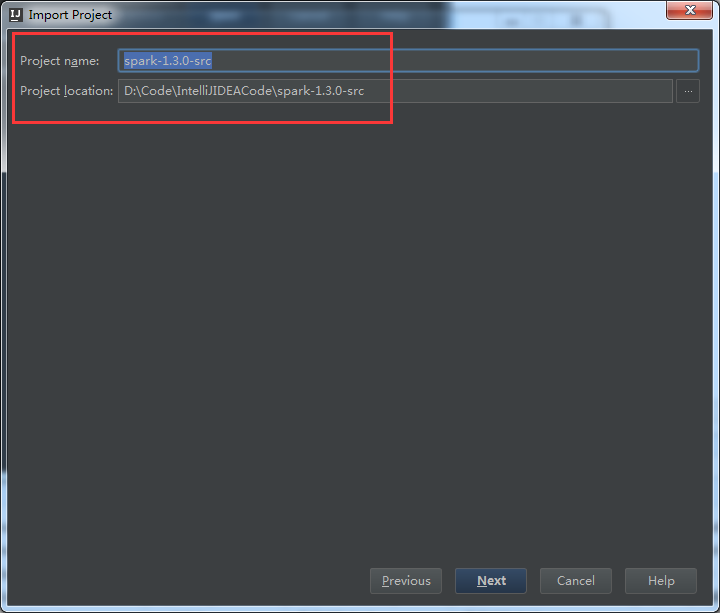

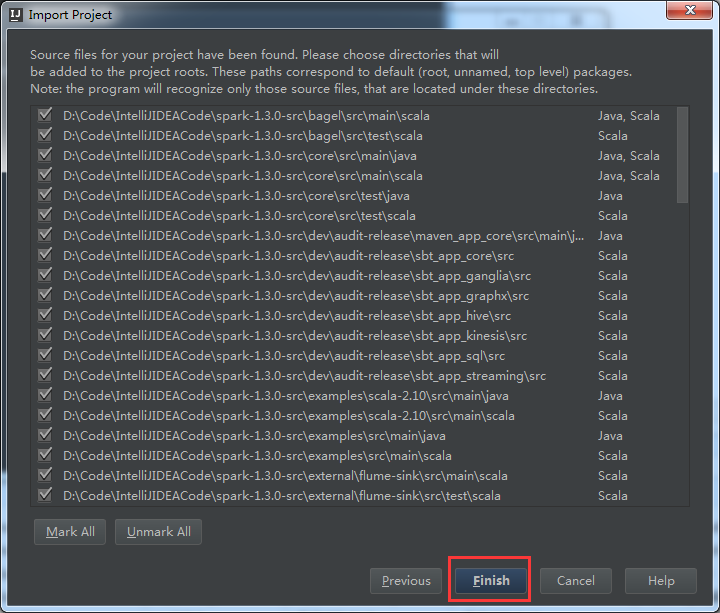

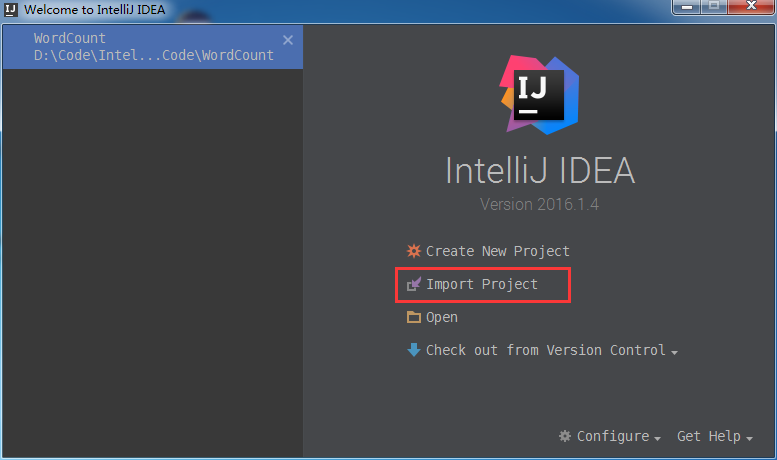

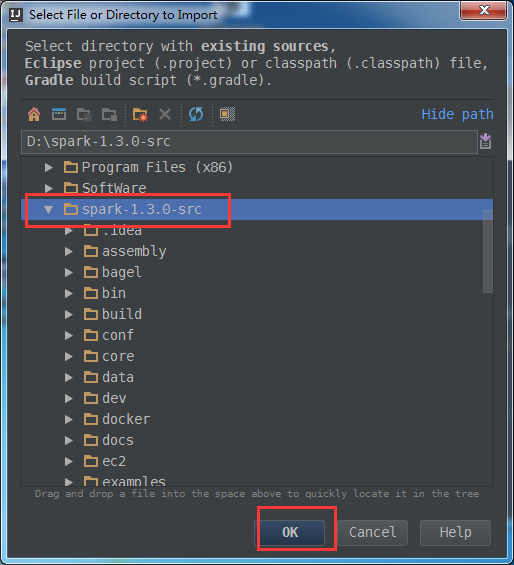

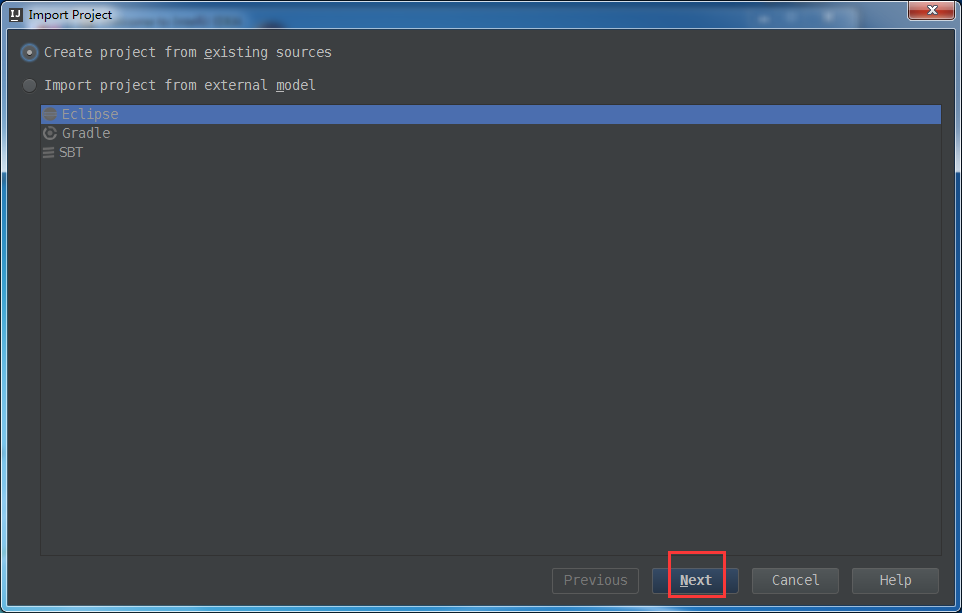

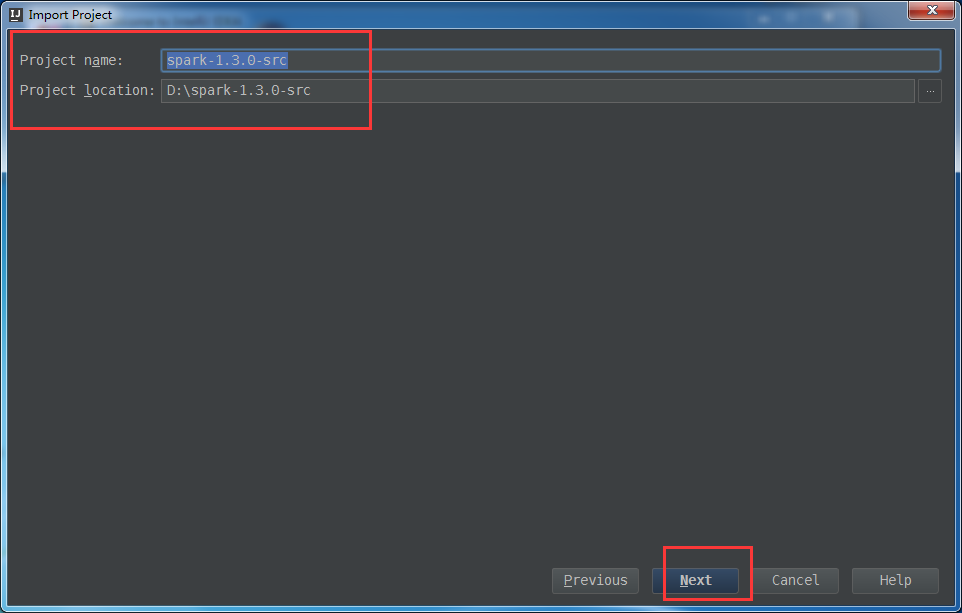

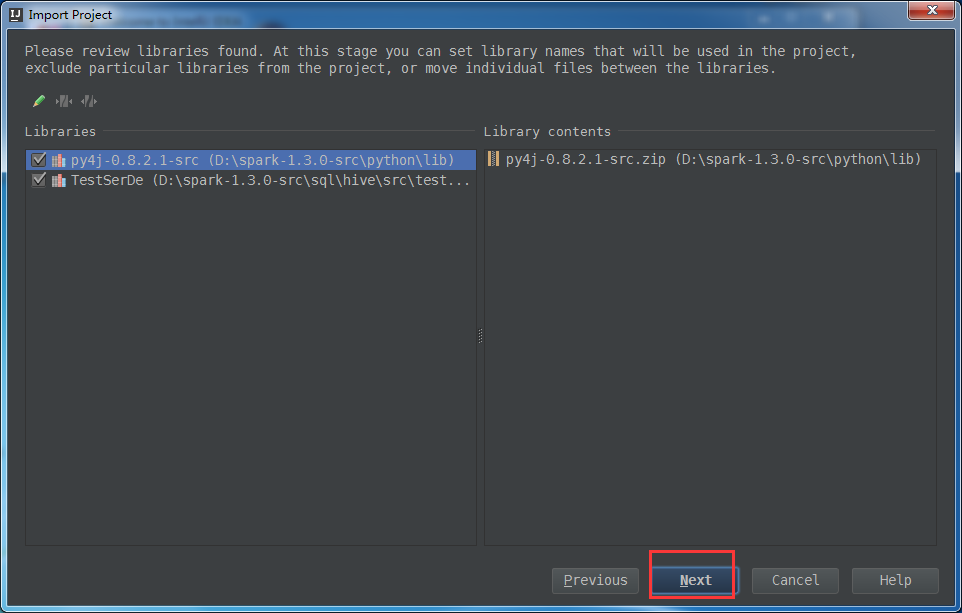

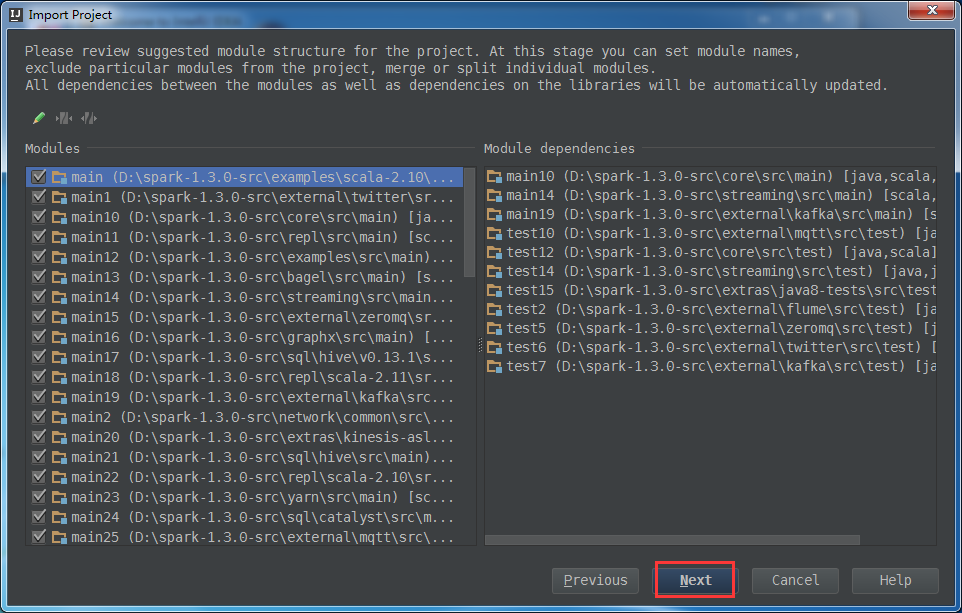

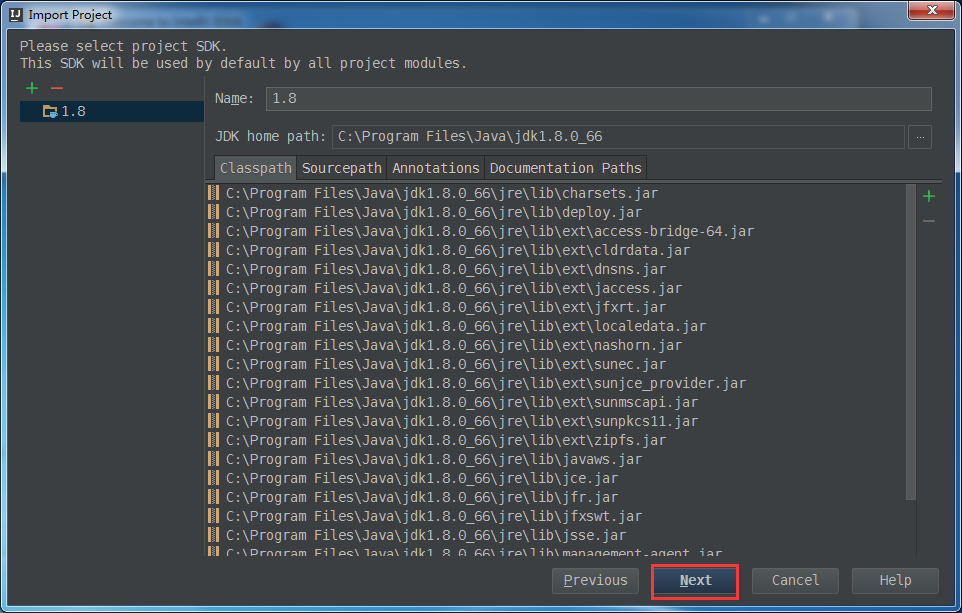

选择,Import Project

这里,为了日后的spark源码阅读环境的方便和开发

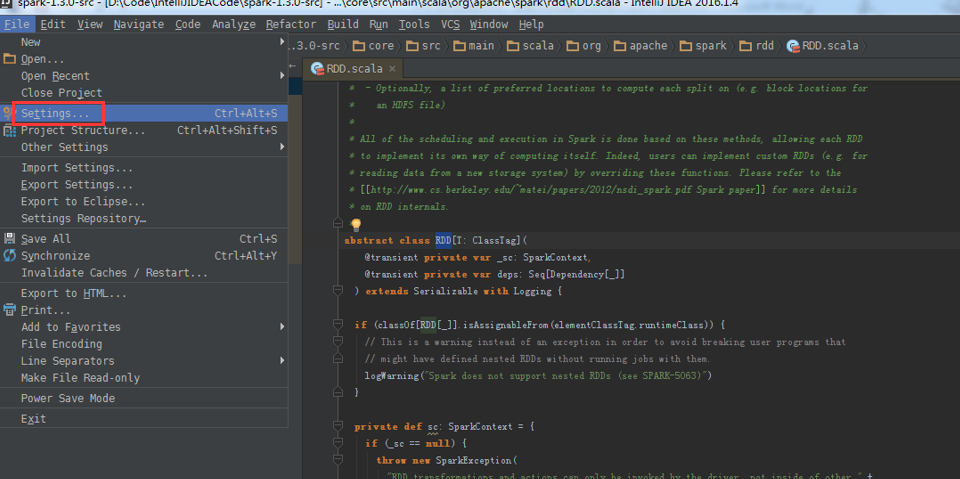

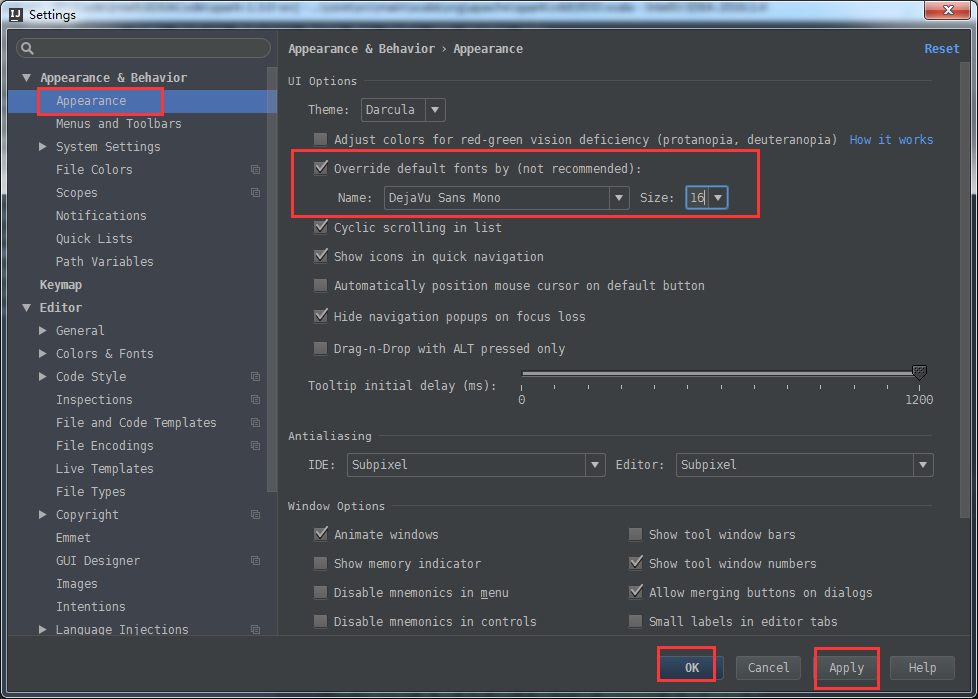

安装之后的几个常用设置:

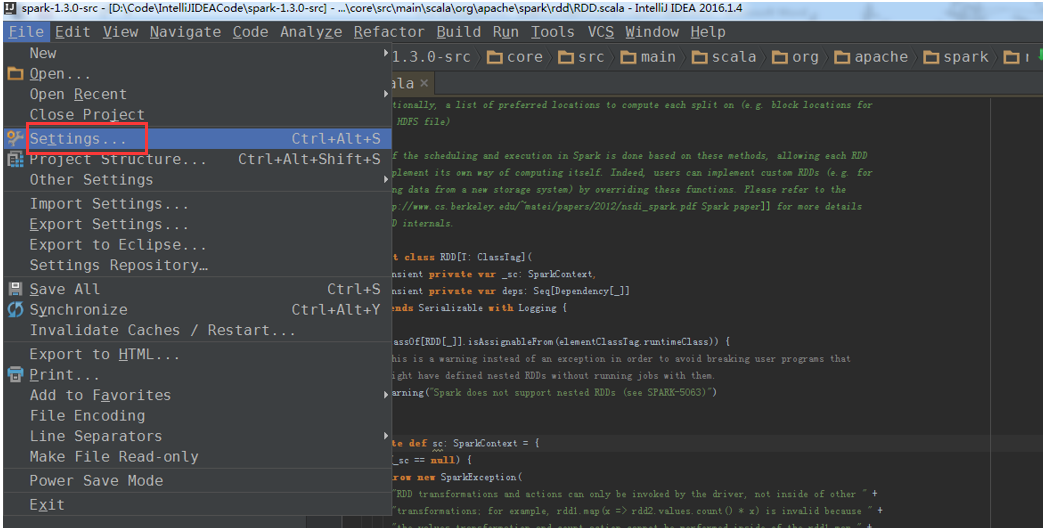

1、界面字体大小的设置

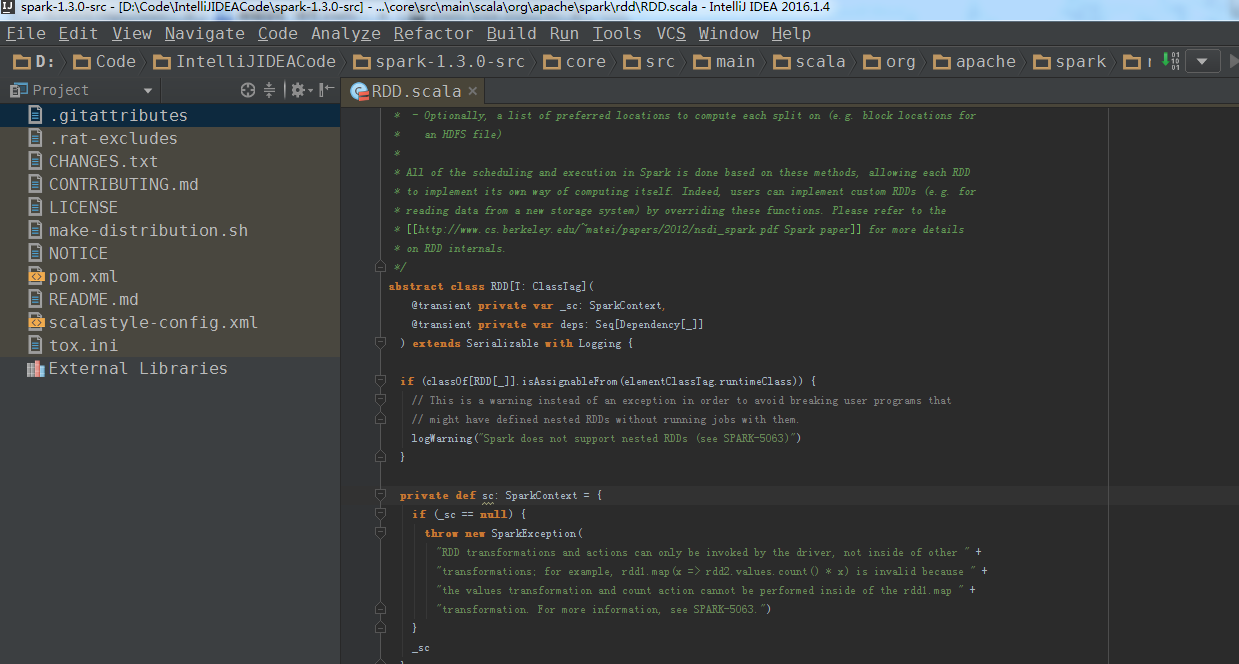

可见,界面字体的效果

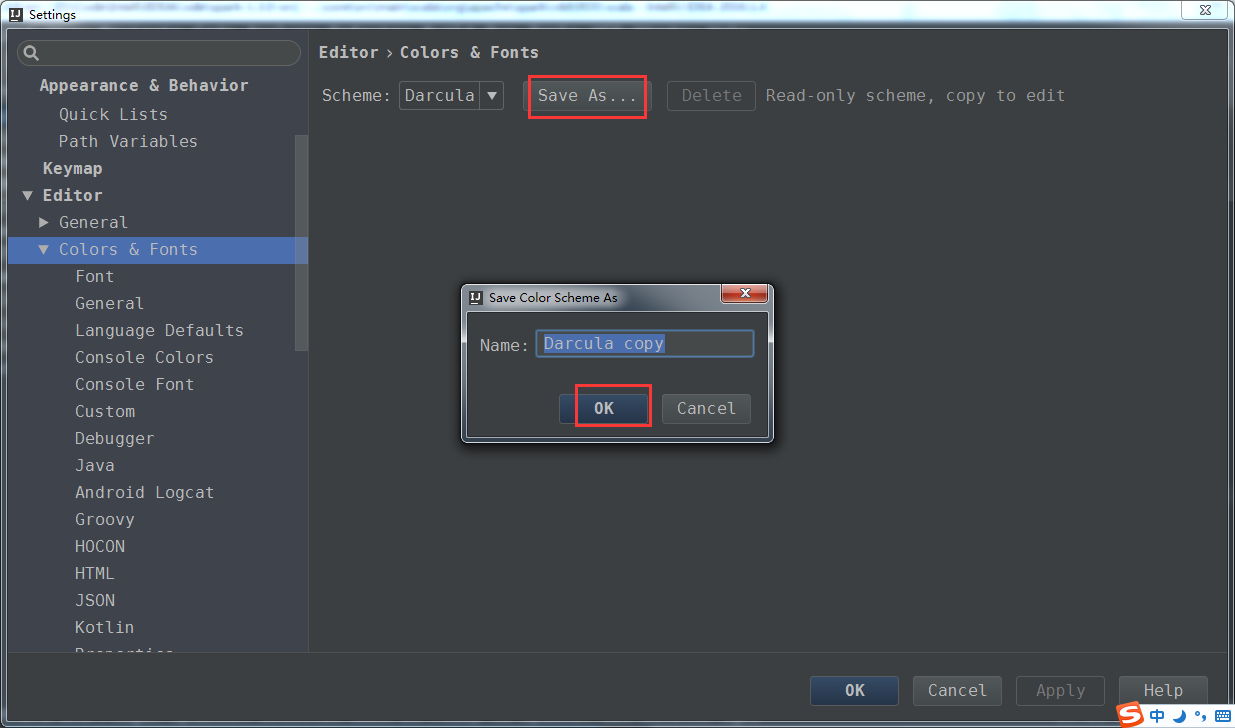

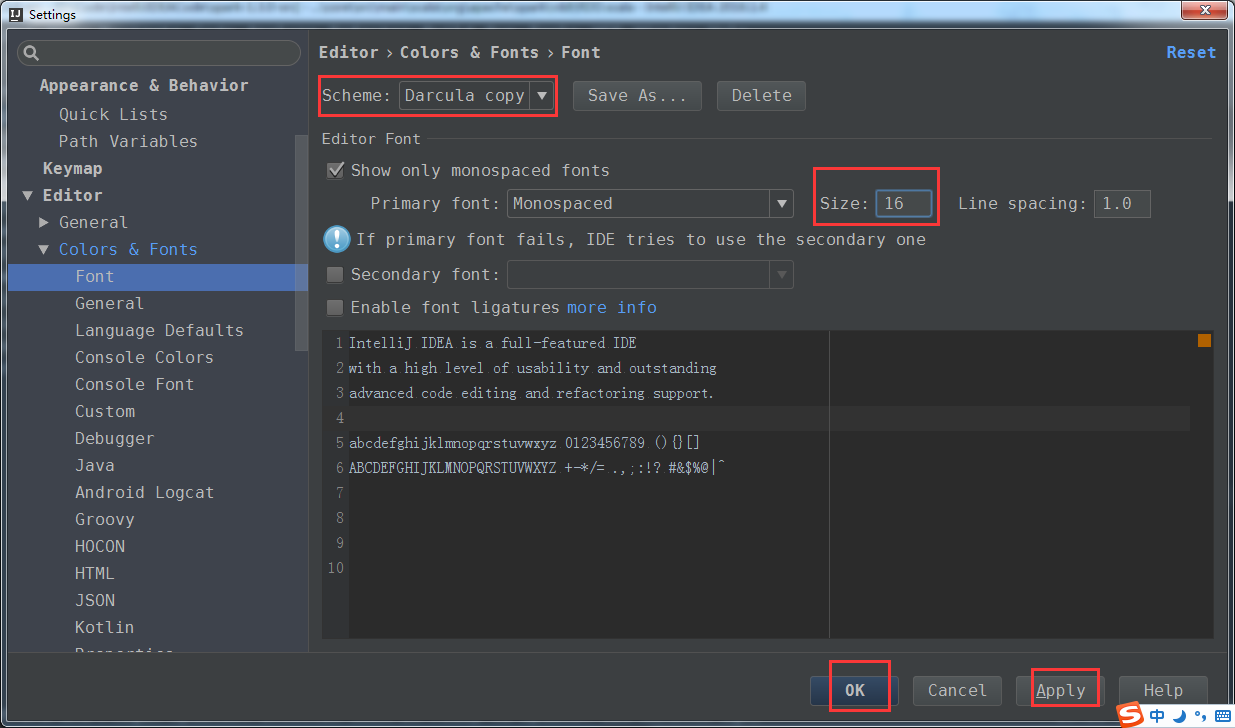

2、代码字体的设置

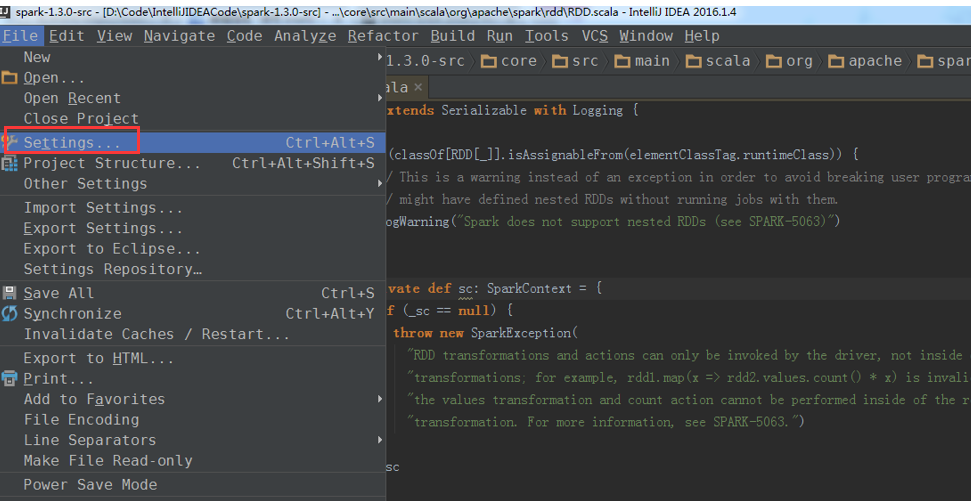

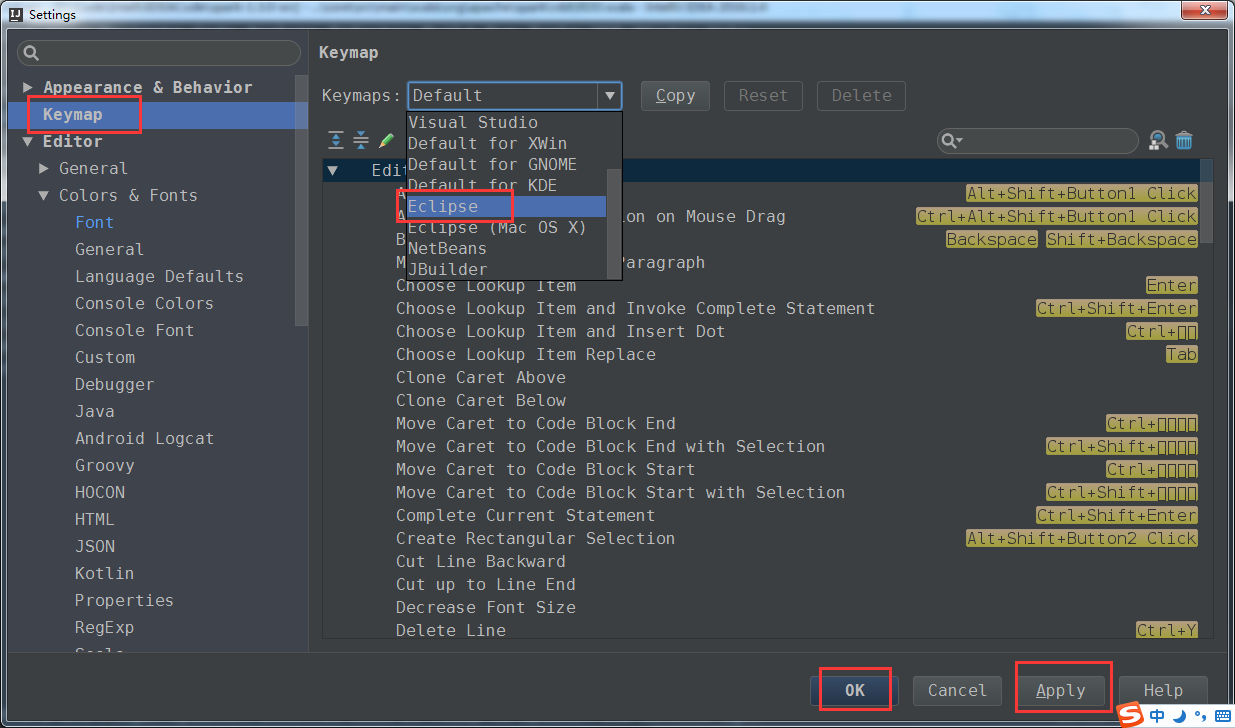

3、因我们平常,用习惯了eclipse,快捷键,设置为我们平常,eclipse的风格。

完成

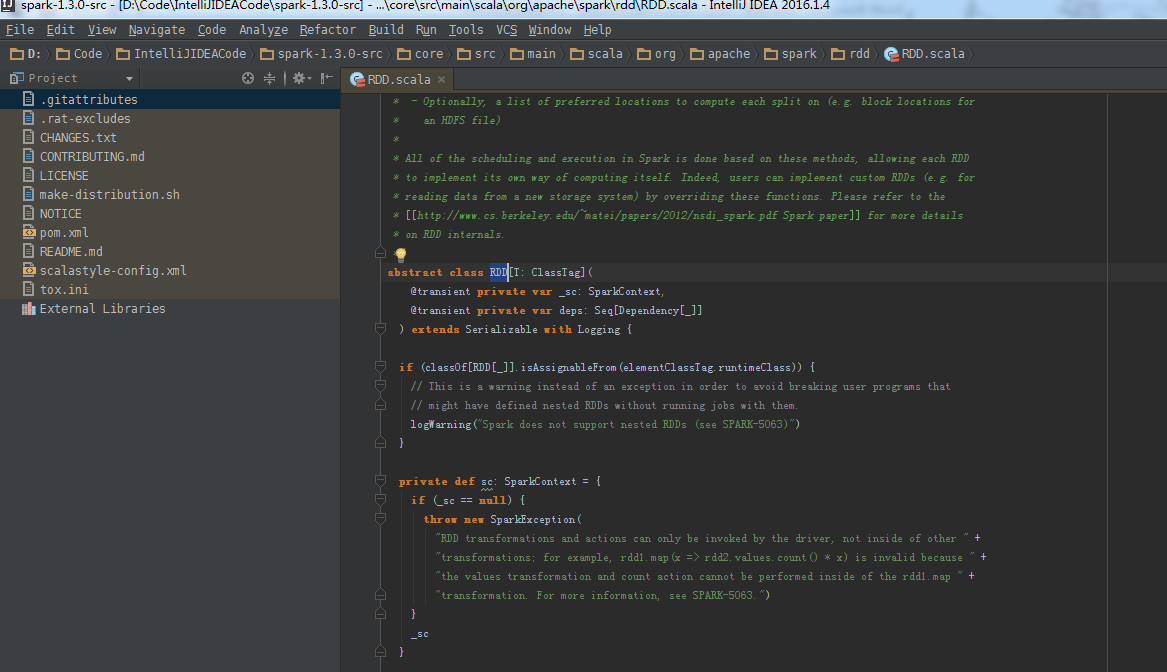

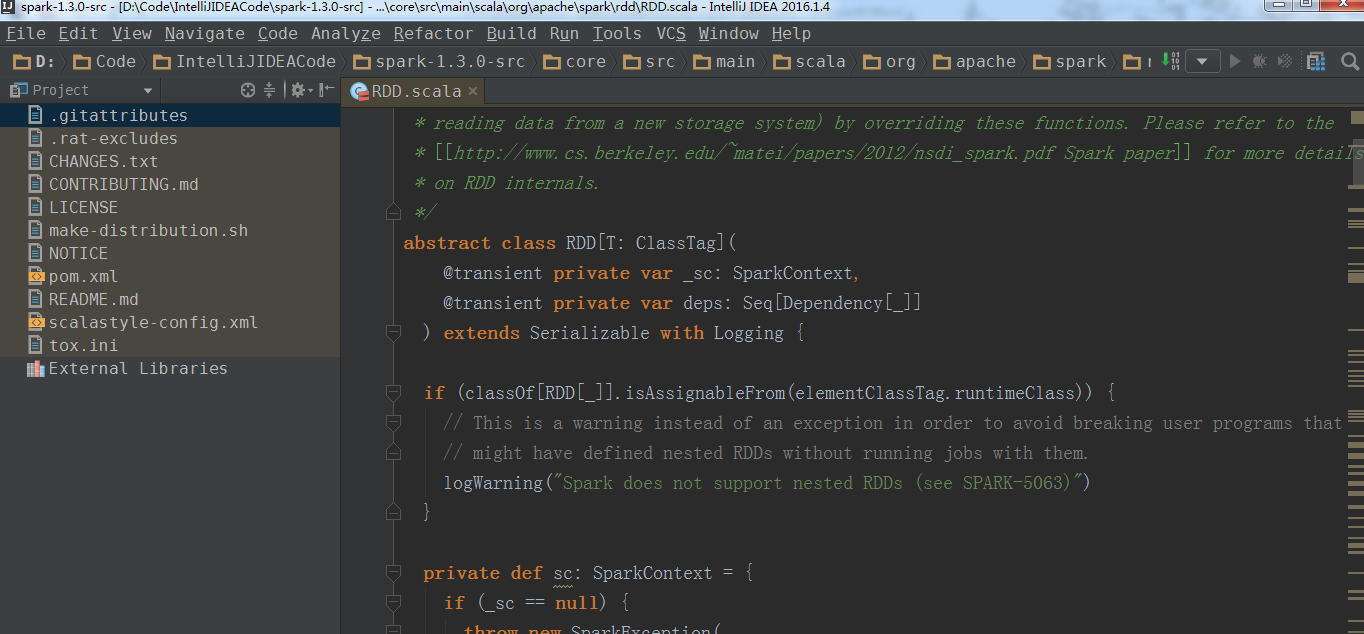

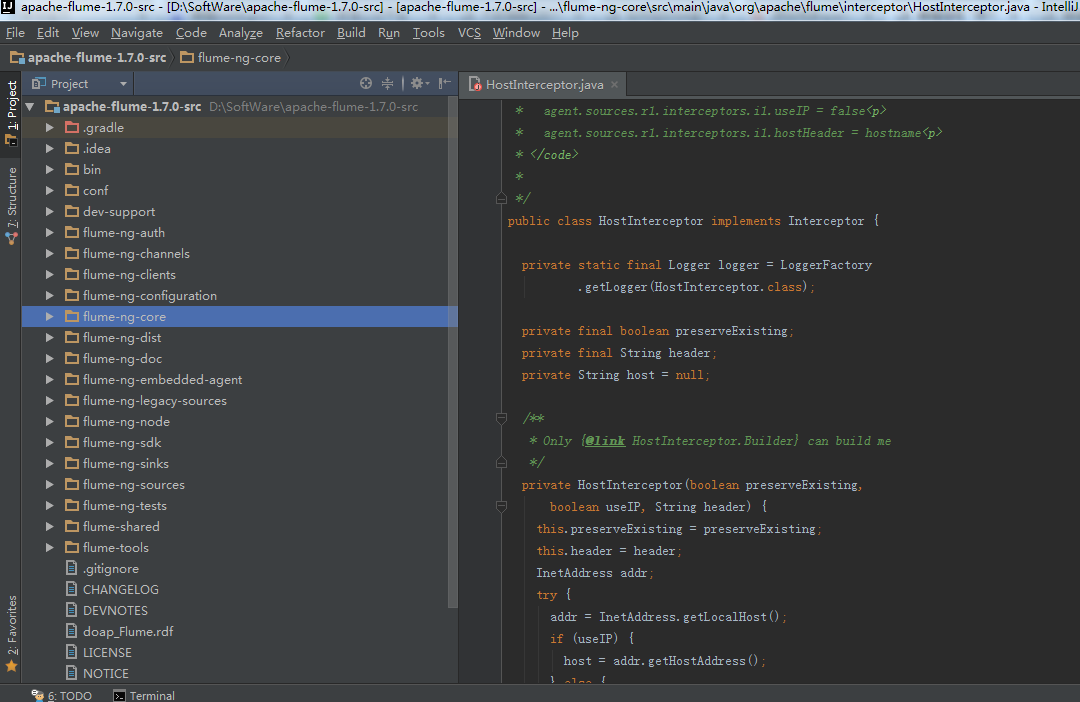

简单,带领,如何巧看spark源码?

这里,为了避免一个不利的阅读,

放到D盘的根目录下,

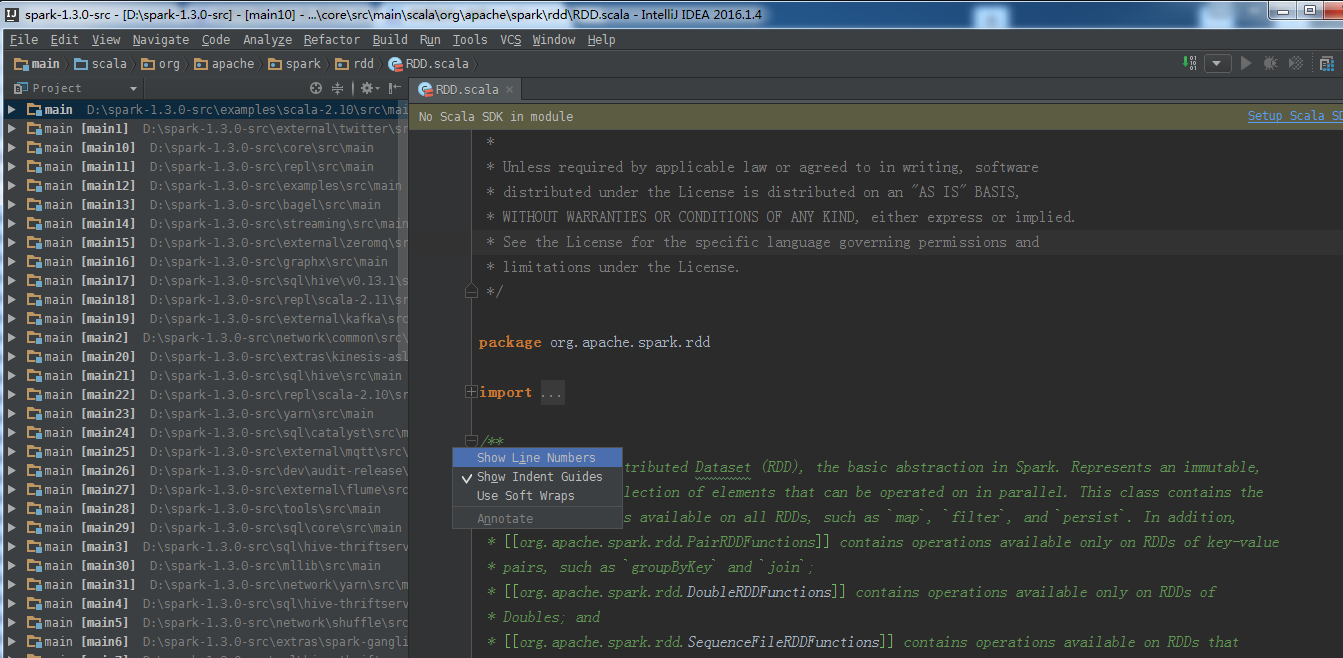

设置行号

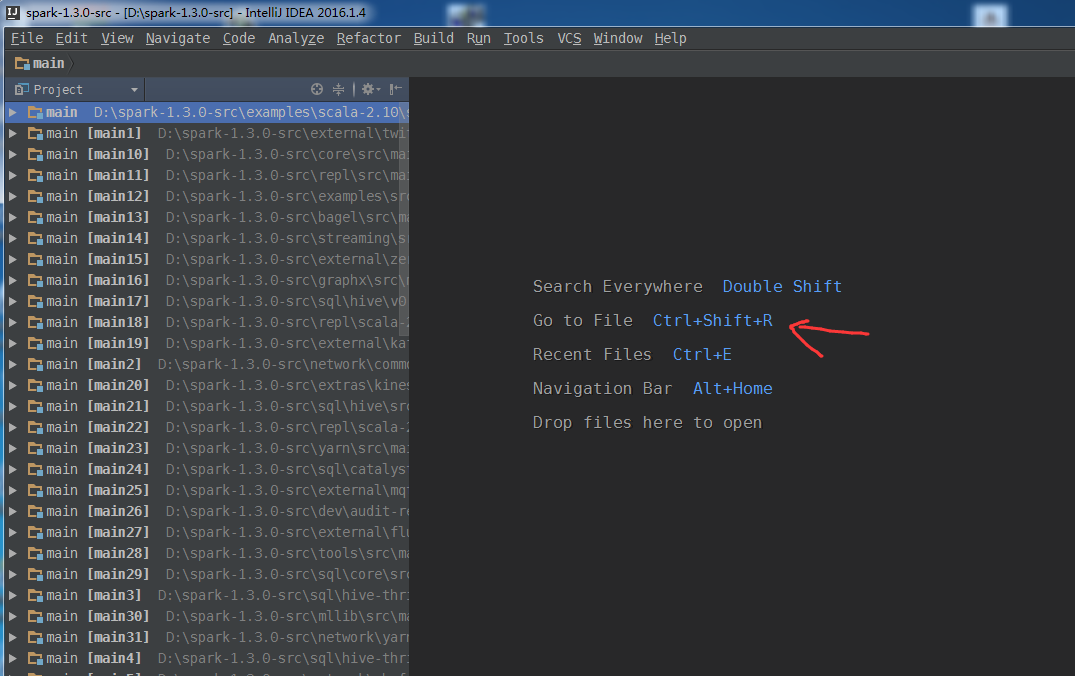

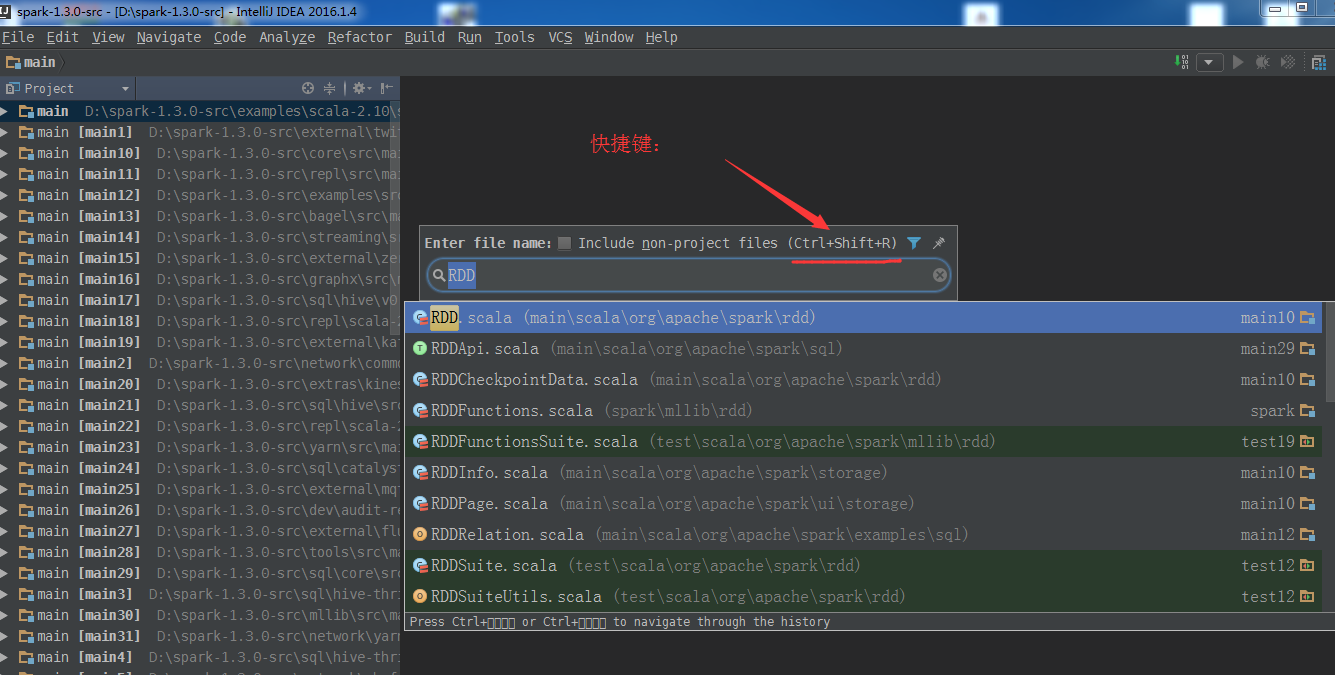

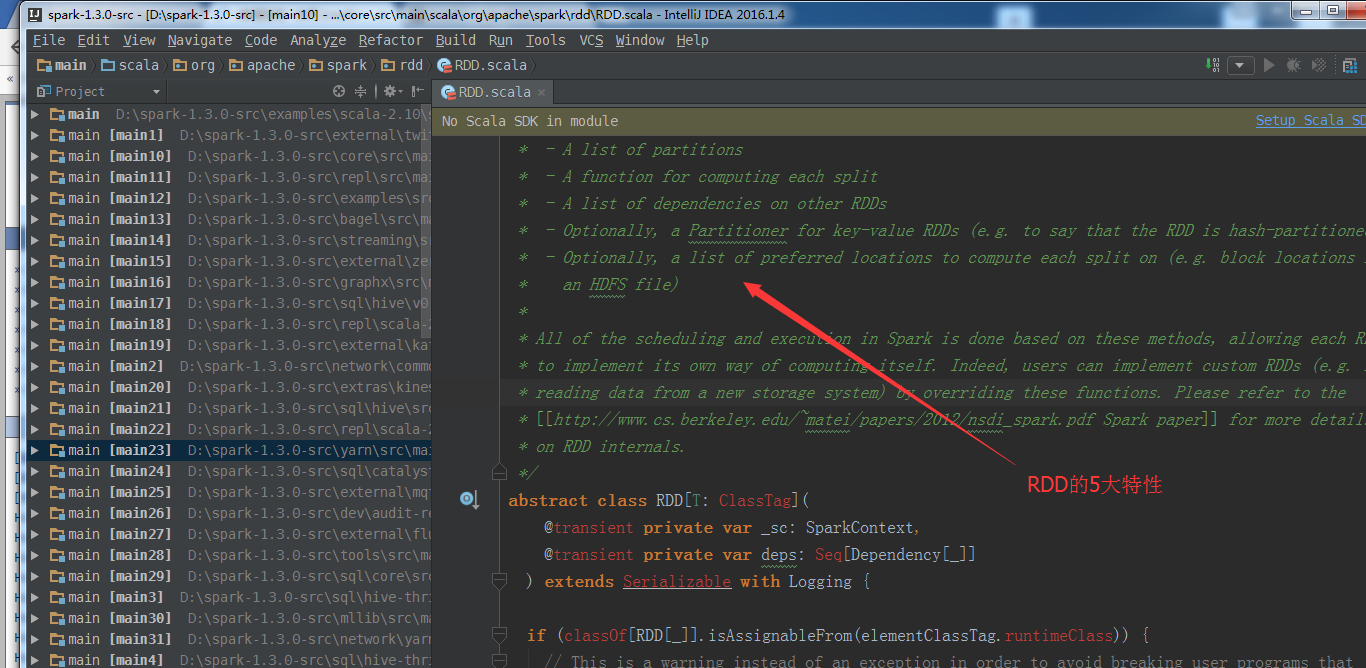

其他的源码,首先,Ctrl + Shift + R,然后,自行去阅读。

建议,在理解概念,真的,可以拿源码来帮助理解!

总结

所以啊,源码 + 官网 ,是黄金组合。

更新博客(2017年),见

spark最新源码下载并导入到开发环境下助推高质量代码(Scala IDEA for Eclipse和IntelliJ IDEA皆适用)(以spark2.2.0源码包为例)(图文详解)

如何在IDEA里给大数据项目导入该项目的相关源码(博主推荐)(图文详解)

同时,大家可以关注我的个人博客:

http://www.cnblogs.com/zlslch/ 和 http://www.cnblogs.com/lchzls/

人生苦短,我愿分享。本公众号将秉持活到老学到老学习无休止的交流分享开源精神,汇聚于互联网和个人学习工作的精华干货知识,一切来于互联网,反馈回互联网。

目前研究领域:大数据、机器学习、深度学习、人工智能、数据挖掘、数据分析。 语言涉及:Java、Scala、Python、Shell、Linux等 。同时还涉及平常所使用的手机、电脑和互联网上的使用技巧、问题和实用软件。 只要你一直关注和呆在群里,每天必须有收获

以及对应本平台的:(大数据躺过的坑)

今天的文章

idea导入不了SparkContext包分享到此就结束了,感谢您的阅读。

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容, 请发送邮件至 举报,一经查实,本站将立刻删除。

如需转载请保留出处:https://bianchenghao.cn/135948.html