作为练手的项目,本来打算爬取点别的,最后还是去爬取了小说网站……

Jsoup是一款Java 的HTML解析器,可直接解析某个URL地址、HTML文本内容。它提供了一套非常省力的API,可通过DOM,CSS以及类似于jQuery的操作方法来取出和操作数据。

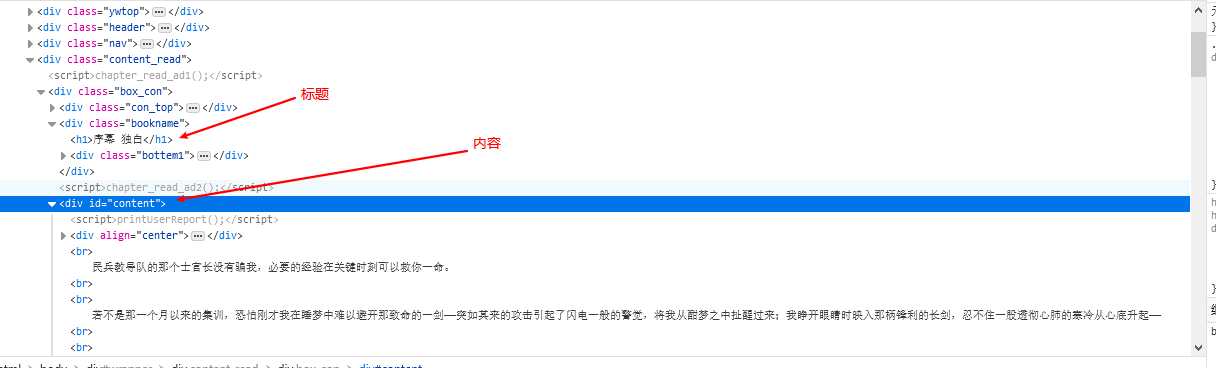

要爬取一个网站,我们首先需要检查网站的结构,这里是我爬取的示例网站的结构,可以看到我们要爬取的内容.

Jsoup为我们提供了基于DOM,CSS以及类似于jQuery的操作方法来取出和操作数据。具体操作见官网链接.

https://www.open-open.com/jsoup/selector-syntax.htm

现在我们可以编写代码了,以下是Jsoup的代码,后面会用WebMagic再写一遍…

package com.litianyi;

import org.jsoup.Jsoup;

import org.jsoup.nodes.Document;

import java.io.File;

import java.io.FileWriter;

import java.io.IOException;

/**

* @author: LiTianyi

* @Date: 2020/1/28 0028 09:50

* @Description

*/

public class NewTest {

private static int count = 0;

private static FileWriter fw;

static {

try {

//文件名

fw = new FileWriter(new File("D:\\Documents\\阅读\\琥珀之剑.txt"));

} catch (IOException e) {

e.printStackTrace();

}

}

public static void htmlHandle(String url) {

String attr = null;

try {

//连接到网页

Document novel = Jsoup.connect(url).get();

//应当爬取哪些数据

String bookname = novel.select("h1").text();

String content = novel.getElementById("content").text();

attr = novel.getElementsByClass("next").attr("href");

String back = novel.getElementsByClass("back").attr("href");

/*预览文件*/

//System.out.print("\n"+bookname+"\n");

//System.out.print(content.replace(" ","\n "));

fw.write("\n"+bookname+"\n");//写入到文件当中

fw.write(content.replace(" ","\n "));

count++;

fw.flush();

if (attr.equals(back)) {

System.out.println("end");

} else {

attr = "https://www.tianna.la" + attr;

//System.out.println(attr);

htmlHandle(attr);

}

} catch (IOException e) {

e.printStackTrace();

}

}

public static void main(String[]args) {

long startTime, endTime;

System.out.println("开始爬取...");

startTime = System.currentTimeMillis();

try {

//开始爬取页面

htmlHandle("https://www.tianna.la/tnw18554/1258407.html");

fw.close();

} catch (IOException e) {

e.printStackTrace();

}

endTime = System.currentTimeMillis();

System.out.println("爬取结束,耗时约" + ((endTime - startTime) / 1000) + "秒,抓取了"+count+"条记录");

}

}

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容, 请发送邮件至 举报,一经查实,本站将立刻删除。

如需转载请保留出处:http://bianchenghao.cn/38707.html