1、在所有节点上安装Docker和kubeadm

2、部署Kubernetes Master

3、部署容器网络插件

4、部署 Kubernetes Node,将节点加入Kubernetes集群中

5、部署 Dashboard Web 页面,可视化查看Kubernetes资源

6、部署 Harbor 私有仓库,存放镜像资源

所有环境

cd /opt

vim zb_k8s.sh

根据配置

在master添加hosts

cat >> /etc/hosts << EOF

192.168.88.76 master01

192.168.88.20 node01

192.168.88.21 node02

192.168.88.77 harbor

vim az_docker.sh

docker info | grep "Cgroup Driver"

- 使用Systemd管理的Cgroup来进行资源控制与管理,因为相对Cgroupfs而言,Systemd限制CPU、内存等资源更加简单和成熟稳定。

- 日志使用json-file格式类型存储,大小为100M,保存在/var/log/containers目录下,方便ELK等日志系统收集和管理日志。

定义kubernetes源

cat > /etc/yum.repos.d/kubernetes.repo << EOF

[kubernetes]

name=Kubernetes

baseurl=https://mirrors.aliyun.com/kubernetes/yum/repos/kubernetes-el7-x86_64

enabled=1

gpgcheck=0

repo_gpgcheck=0

gpgkey=https://mirrors.aliyun.com/kubernetes/yum/doc/yum-key.gpg https://mirrors.aliyun.com/kubernetes/yum/doc/rpm-package-key.gpg

EOF

yum install -y kubelet-1.20.11 kubeadm-1.20.11 kubectl-1.20.11

- K8S通过kubeadm安装出来以后都是以Pod方式存在,即底层是以容器方式运行,所以kubelet必须设置开机自启

在 master 节点上传 v1.20.11.zip 压缩包至 /opt 目录

unzip v1.20.11.zip -d /opt/k8s

cd /opt/k8s/v1.20.11

for i in $(ls *.tar); do docker load -i $i; done

复制镜像和脚本到 node 节点,

scp -r /opt/k8s root@node01:/opt

scp -r /opt/k8s root@node02:/opt

并在 node 01、02节点上也执行脚本加载镜像文件

①、方法一

注意master01 node01 node02都需要操作

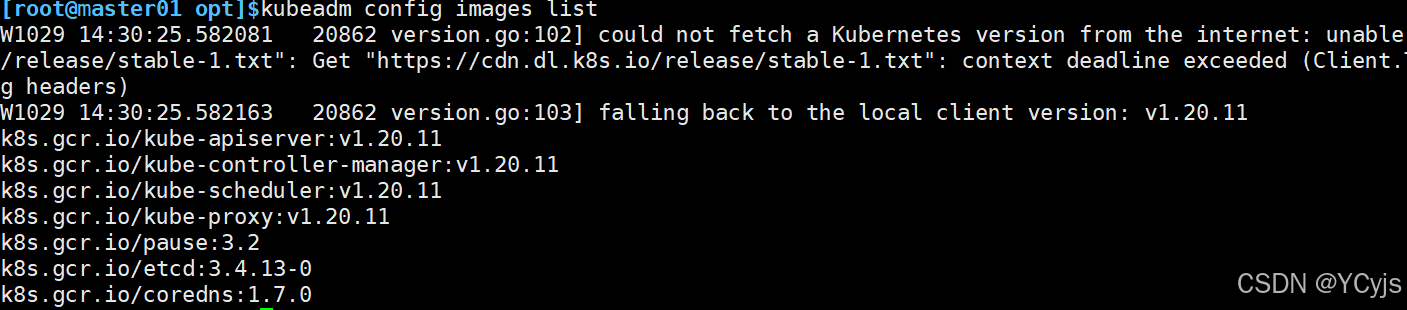

kubeadm config print init-defaults > /opt/kubeadm-config.yaml

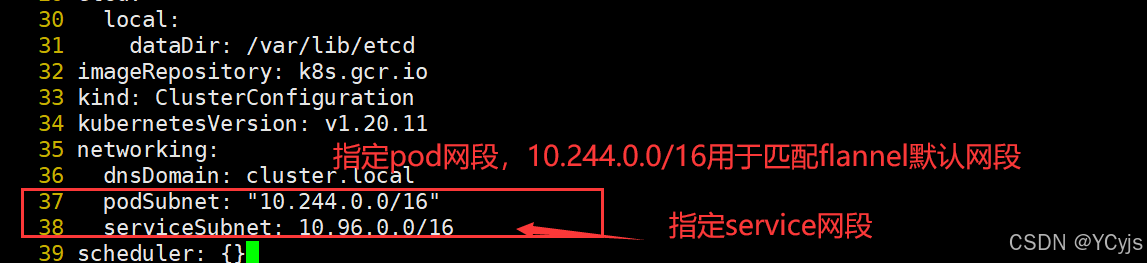

37行 podSubnet: "10.244.0.0/16"

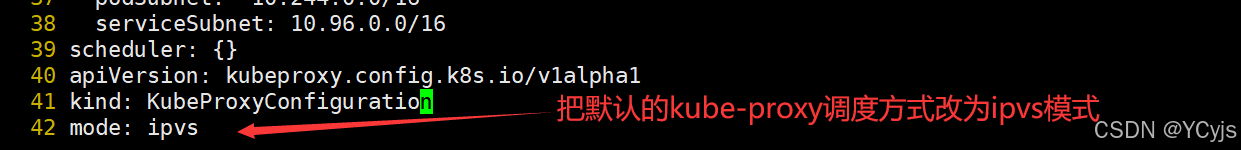

末尾再添加以下内容

---

apiVersion: kubeproxy.config.k8s.io/v1alpha1

kind: KubeProxyConfiguration

mode: ipvs

在master01上 开启集群,等待node节点加入

kubeadm init --config=kubeadm-config.yaml --upload-certs | tee kubeadm-init.log

- --experimental-upload-certs 参数可以在后续执行加入节点时自动分发证书文件,K8S V1.16版本开始替换为 --upload-certs

- tee kubeadm-init.log 用以输出日志

②、方法二

kubeadm init

--apiserver-advertise-address=192.168.88.76

--image-repository registry.aliyuncs.com/google_containers

--kubernetes-version=v1.20.11

--service-cidr=10.96.0.0/16

--pod-network-cidr=10.244.0.0/16

--token-ttl=0

方法二初始化后需要修改 kube-proxy 的 configmap,开启 ipvs

kubectl edit cm kube-proxy -n=kube-system

修改mode: ipvs

在master01上

kubectl需经由API server认证及授权后方能执行相应的管理操作,kubeadm 部署的集群为其生成了一个具有管理员权限的认证配置文件 /etc/kubernetes/admin.conf,它可由 kubectl 通过默认的 “$HOME/.kube/config” 的路径进行加载。

mkdir -p $HOME/.kube

cp -i /etc/kubernetes/admin.conf $HOME/.kube/config

chown $(id -u):$(id -g) $HOME/.kube/config

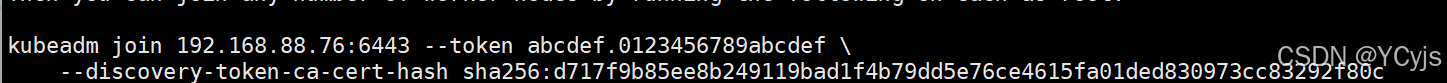

加入在 node01和node02 节点上执行 kubeadm join 命令加入群集

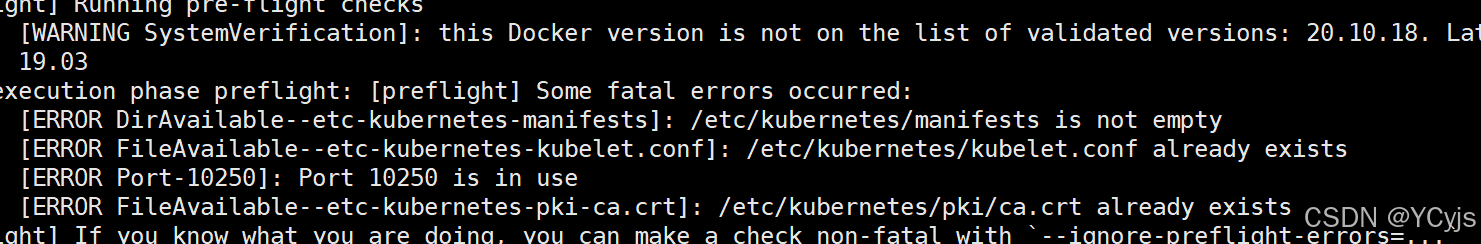

- 和Kubernetes相关配置文件已存在并被占用

- 可以用kubeadm reset重新加入

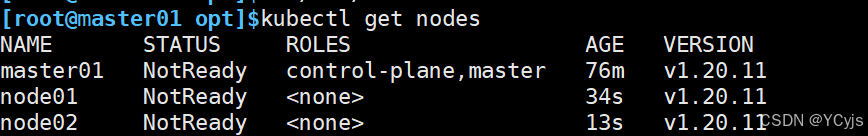

kubectl get nodes

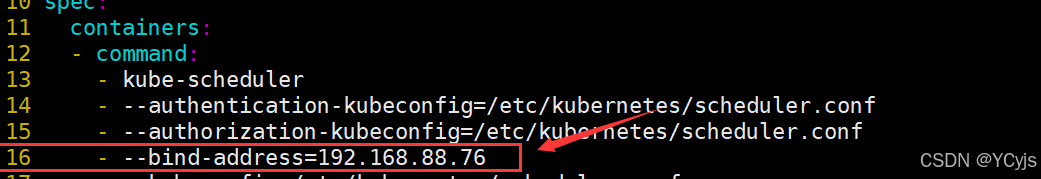

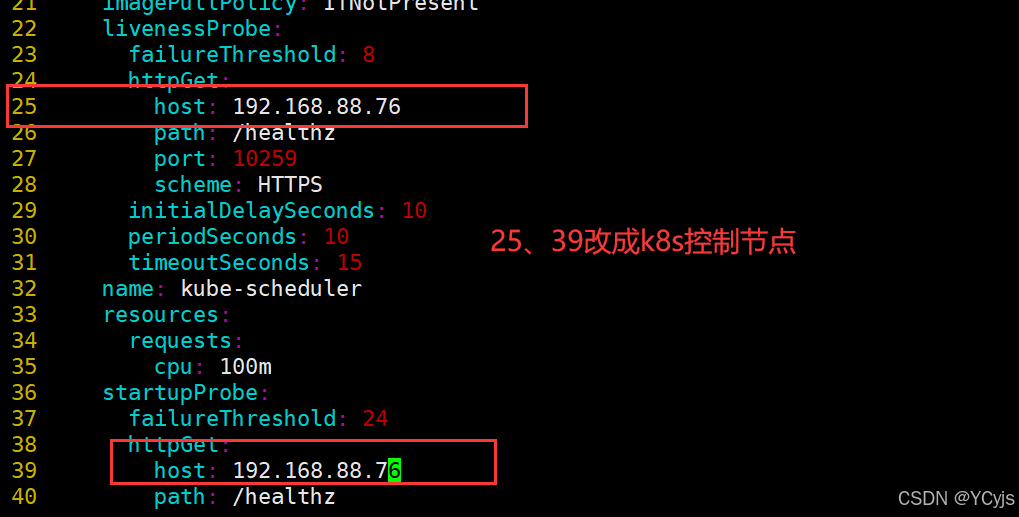

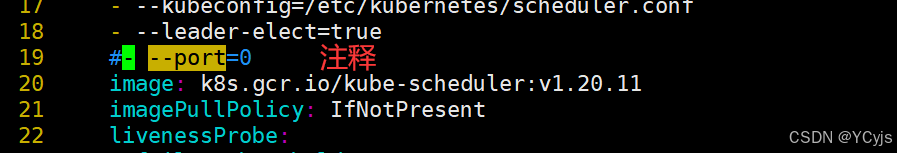

如果 kubectl get cs 发现集群不健康,在master01上更改以下两个文件

vim /etc/kubernetes/manifests/kube-scheduler.yaml

vim /etc/kubernetes/manifests/kube-controller-manager.yaml

修改如下内容(以kube-scheduler为例子)

systemctl restart kubelet

所有节点部署网络插件flannel(在master和两个node节点部署网络插件flannel)

方法一:

所有节点上传flannel镜像 flannel.tar 到 /opt 目录,

在master节点上传 kube-flannel.yml 文件

方法二(可能会卡推荐一)

kubectl apply -f https://raw.githubusercontent.com/coreos/flannel/master/Documentation/kube-flannel.yml

kubectl apply -f https://github.com/flannel-io/flannel/releases/latest/download/kube-flannel.yml

kubectl get pods -n kube-system

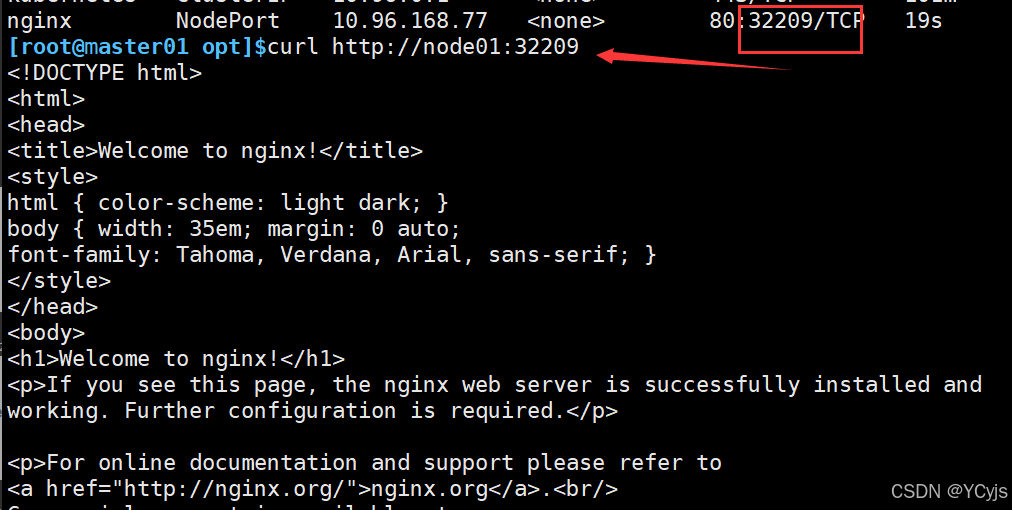

测试 pod 资源创建

kubectl create deployment nginx --image=nginx

kubectl get pods -o wide 暴露端口提供服务

暴露端口提供服务

kubectl expose deployment nginx --port=80 --type=NodePort

kubectl get svc

扩展3个副本

kubectl scale deployment nginx --replicas=3

kubectl get pods -o wide

需要等待一会

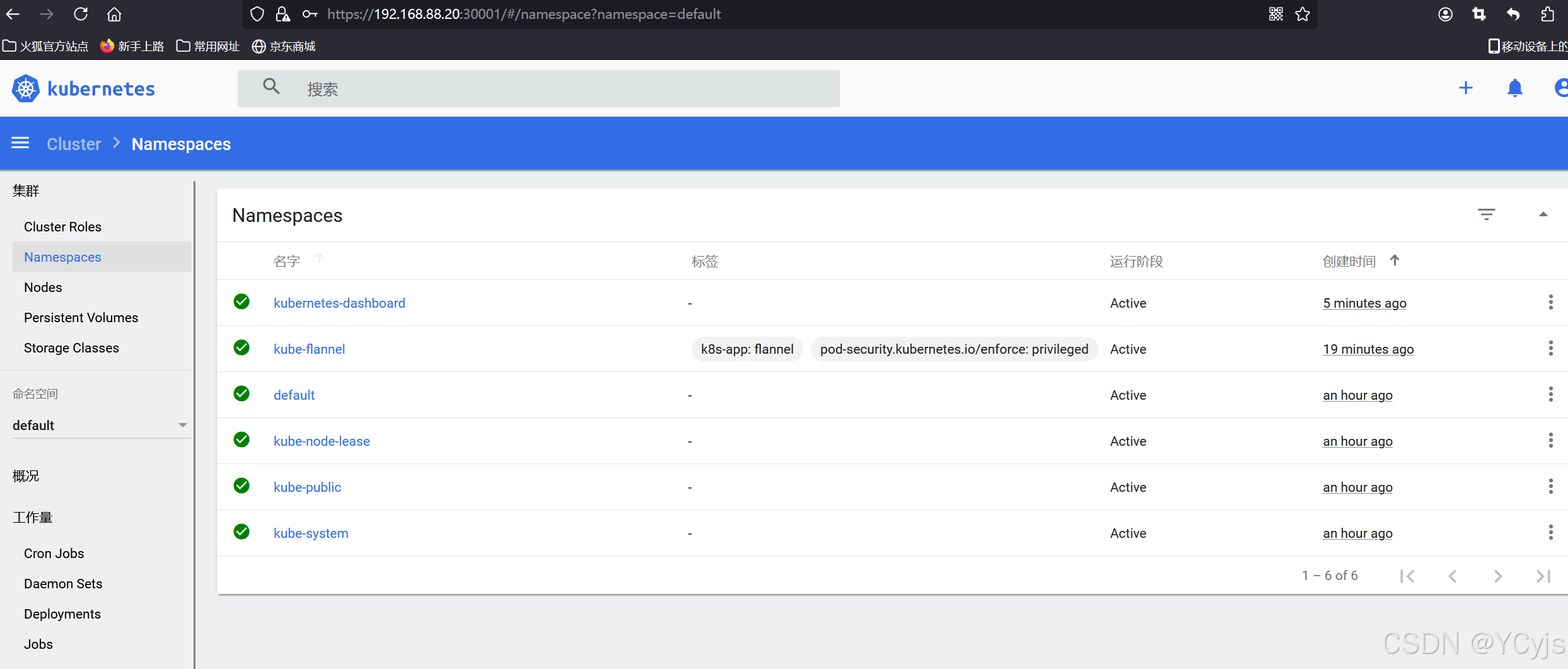

在 master01 节点上操作

上传 recommended.yaml 文件到 /opt/k8s 目录中

cd /opt/k8s

vim recommended.yaml

- 默认Dashboard只能集群内部访问,修改Service为NodePort类型,暴露到外部:

创建service account并绑定默认cluster-admin管理员集群角色

kubectl create serviceaccount dashboard-admin -n kube-system

kubectl create clusterrolebinding dashboard-admin --clusterrole=cluster-admin --serviceaccount=kube-system:dashboard-admin

kubectl describe secrets -n kube-system $(kubectl -n kube-system get secret | awk '/dashboard-admin/{print $1}')

所有节点加上主机名映射

echo '192.168.88.77 hub.yc.com' >> /etc/hosts

②、安装 docker

在环境准备已经安装

vim /etc/docker/daemon.json

{

"registry-mirrors": ["https://6xxxxxxxxxxxom"],

"exec-opts": ["native.cgroupdriver=systemd"],

"log-driver": "json-file",

"log-opts": {

"max-size": "100m"

},

"insecure-registries": ["https://hub.yc.com"]

}

EOF

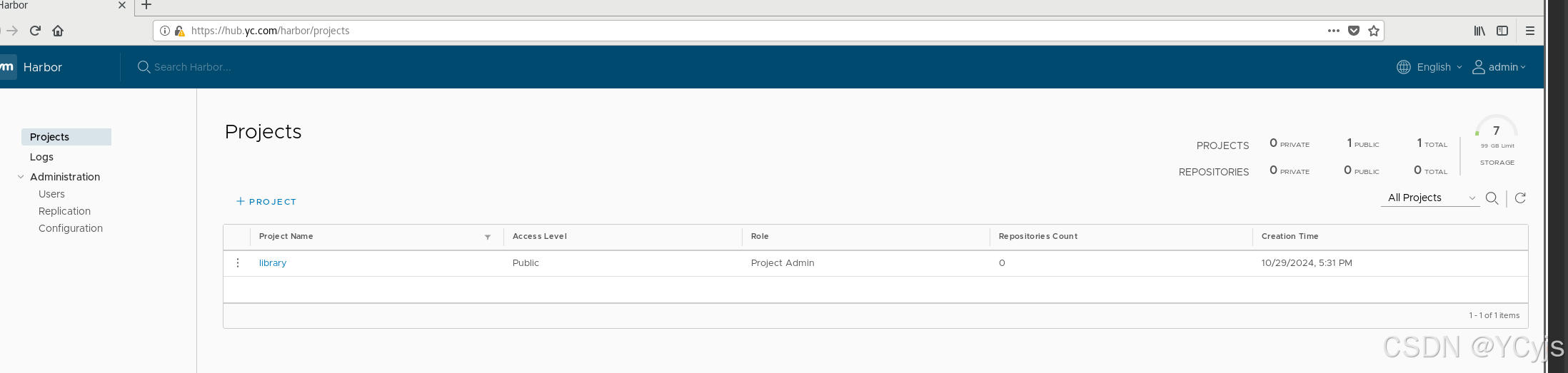

③、安装 Harbor

上传 harbor-offline-installer-v1.2.2.tgz 和 docker-compose 文件到 /opt 目录

cd /opt

cp docker-compose /usr/local/bin/

chmod +x /usr/local/bin/docker-compose

tar zxvf harbor-offline-installer-v1.2.2.tgz

cd harbor/

vim harbor.cfg

④、生成证书

mkdir -p /data/cert

cd /data/cert

生成私钥

openssl genrsa -des3 -out server.key 2048

输入两遍密码:

输入私钥密码:

输入国家名:CN

输入省名:BJ

输入市名:BJ

输入组织名:YC

输入机构名:YC

输入域名:hub.yc.com

输入管理员邮箱:

其它全部直接回车

清除私钥密码

openssl rsa -in server.key.org -out server.key

输入私钥密码:

签名证书

openssl x509 -req -days 1000 -in server.csr -signkey server.key -out server.crt

chmod +x /data/cert/*

在本地使用火狐浏览器访问:https://hub.yc.com

添加例外 -> 确认安全例外

用户名:admin

密码:Harbor12345

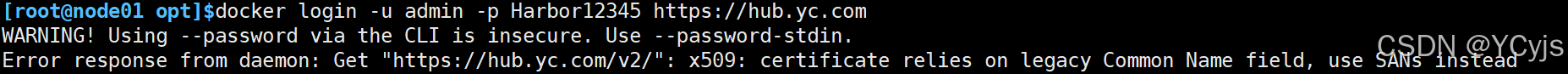

⑤、测试

报错

需要vim /etc/docker/daemon.json修改添加一行

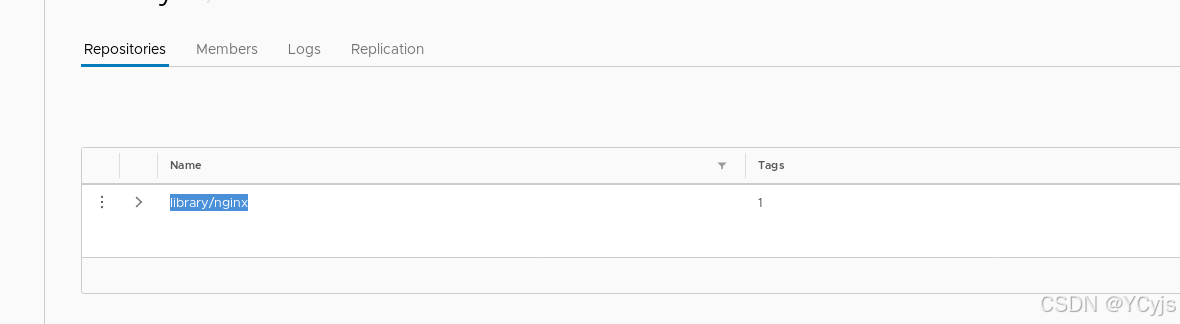

上传镜像

docker tag nginx:latest hub.yc.com/library/nginx:v1

docker push hub.yc.com/library/nginx:v1

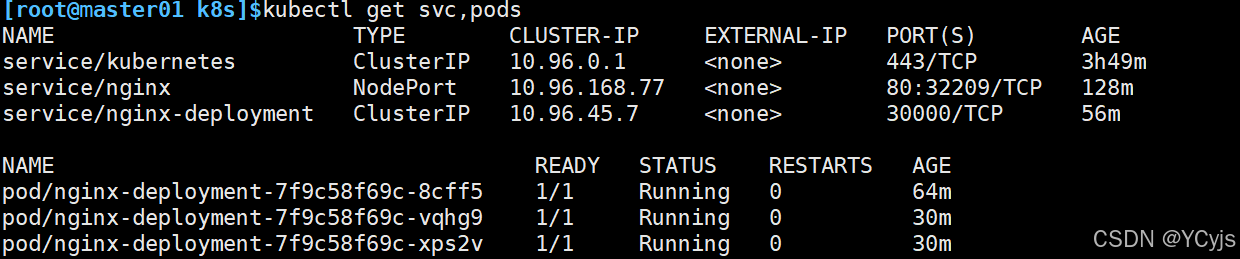

kubectl create deployment nginx-deployment --image=hub.yc.com/library/nginx:v1 --port=80 --replicas=3

kubectl expose deployment nginx-deployment --port=30000 --target-port=80

kubectl get svc,pods

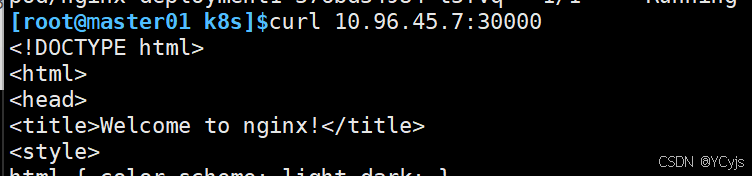

yum install ipvsadm -y

ipvsadm -Ln

curl 10.96.45.7:30000

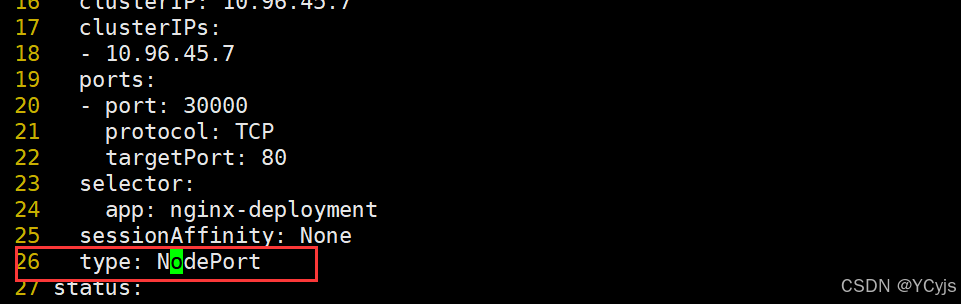

kubectl edit svc nginx-deployment

25 type: NodePort #把调度策略改成NodePort

kubectl get svc

浏览器访问:

192.168.88.76:31199

192.168.88.20:31199

192.168.88.21:31199

cat > /etc/sysctl.d/kubernetes.conf <<EOF

net.bridge.bridge-nf-call-iptables=1

net.bridge.bridge-nf-call-ip6tables=1

net.ipv4.ip_forward=1

net.ipv4.tcp_tw_recycle=0

vm.swappiness=0 #禁止使用 swap 空间,只有当系统内存不足(OOM)时才允许使用它

vm.overcommit_memory=1 #不检查物理内存是否够用

vm.panic_on_oom=0 #开启 OOM

fs.inotify.max_user_instances=8192

fs.inotify.max_user_watches=

fs.file-max= #指定最大文件句柄数

fs.nr_open= #仅4.4以上版本支持

net.ipv6.conf.all.disable_ipv6=1

net.netfilter.nf_conntrack_max=

EOF

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容, 请发送邮件至 举报,一经查实,本站将立刻删除。

如需转载请保留出处:https://bianchenghao.cn/bian-cheng-ri-ji/47022.html