其实没有多大的区别,就是逻辑回归多了一个Sigmoid函数,使样本能映射到[0,1]之间的数值,用来做分类问题。

简单的例子就是可以使用吴恩达的课程中的例子来解释,线性回归用来预测房价,能找到一个公式来尽量拟合房价和影响房价因素之间的关系,最后得到的公式能准确的用来预测房价。在对参数不断调优以找到一组最拟合数据的参数来构成一个最好的模型,就是线性回归。

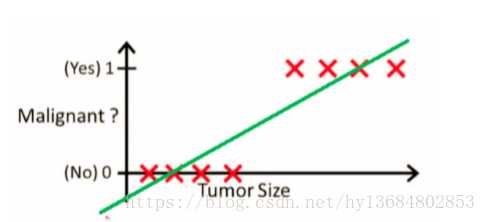

在吴恩达的课程中举了一个癌症的例子

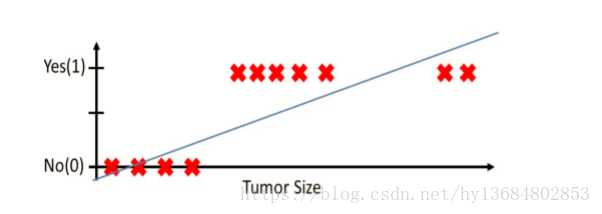

如果我们用线性回归来预测癌症的话,可以想象对于这种分类问题,线性回归很难找到一个完美拟合数据的模型,而且一些特别的数据,也就是噪音会对它的准确率产生很大的影响。

在新加一组数据之后,方程的准确率降低了很多很多,所以线性回归更适合用来预测数据,对于这种分类问题还是需要逻辑回归来解决。

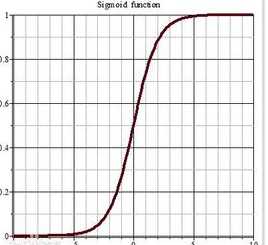

前面已经说了,逻辑回归通过Sigmoid函数将任何连续的数值映射到[0,1]之间

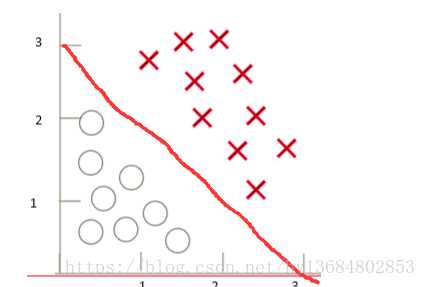

这样就可以找到一组参数,将样本分为两类,

综上:线性回归用来预测,逻辑回归用来分类。

线性回归是拟合函数,逻辑回归是预测函数

线性回归的参数计算方法是最小二乘法,逻辑回归的参数计算方法是梯度下降

1)线性回归要求变量服从正态分布,logistic回归对变量分布没有要求。

2)线性回归要求因变量是连续性数值变量,而logistic回归要求因变量是分类型变量。

3)线性回归要求自变量和因变量呈线性关系,而logistic回归不要求自变量和因变量呈线性关系

4)logistic回归是分析因变量取某个值的概率与自变量的关系,而线性回归是直接分析因变量与自变量的关系

总之,

logistic回归与线性回归实际上有很多相同之处,最大的区别就在于他们的因变量不同,其他的基本都差不多,正是因为如此,这两种回归可以归于同一个家族,即广义线性模型(generalized

linear

model)。这一家族中的模型形式基本上都差不多,不同的就是因变量不同,如果是连续的,就是多重线性回归,如果是二项分布,就是logistic回归。logistic回归的因变量可以是二分类的,也可以是多分类的,但是二分类的更为常用,也更加容易解释。所以实际中最为常用的就是二分类的logistic回归。

今天的文章线性回归于逻辑回归的区别分享到此就结束了,感谢您的阅读。

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容, 请发送邮件至 举报,一经查实,本站将立刻删除。

如需转载请保留出处:https://bianchenghao.cn/11780.html