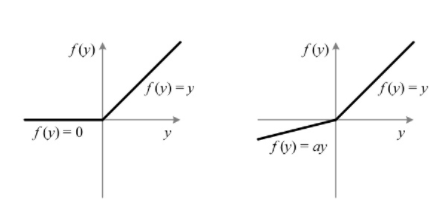

PReLU 新的激活函数 (Parametric Rectified Linear Unit),该激活函数可以自适应地学习矫正线性单元的参数,并且能够在增加可忽略的额外计算成本下提高准确率。

允许不同通道的激活函数不一样。当时a=0,PReLU就变成了ReLU,而且 a 是一个可以学习的参数。

如果 a 是一个小的固定值, PReLU就变成了 LReLU (Leaky ReLU)。

LReLU目的是为了避免零梯度,实验表明LReLU相较 ReLU对准确率几乎没有提高,但是PReLU的参数 a 可以自适应学习,从而可以获得专门的激活函数

PReLU – 知乎

卷积核权重初始化

今天的文章PReLU, LReLU, ReLU分享到此就结束了,感谢您的阅读。

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容, 请发送邮件至 举报,一经查实,本站将立刻删除。

如需转载请保留出处:https://bianchenghao.cn/72199.html