一、总体标准偏差和样本标准偏差

假设我们测量了变量 x x x,测得的结果是 x 1 , x 2 , ⋯ , x n x_1,x_2,\cdots,x_n x1,x2,⋯,xn。令 x ˉ \bar x xˉ是它们的算术平均值, μ \mu μ是 x x x的真实值。

我们使用标准(偏)差(Standard Deviation)来度量数据分布的分散程度。标准差越大,数据分布越离散,反之越集中。

我们在小学/初中学过标准差的计算公式 σ = ∑ i = 1 N ( x i − μ ) 2 N \sigma=\sqrt{\frac{\sum_{i=1}^{N}(x_i-\mu)^2}{N}} σ=N∑i=1N(xi−μ)2其中 μ \mu μ是总体的平均值。但是物理实验中采用的是 S = ∑ i = 1 n ( x i − x ˉ ) 2 n − 1 S=\sqrt{\frac{\sum_{i=1}^{n}(x_i-\bar x)^2}{n-1}} S=n−1∑i=1n(xi−xˉ)2其中 x ˉ \bar x xˉ是样本的平均值。那为什么分母变成 n − 1 n-1 n−1了呢?包括我在内的很多人都不理解。

实际上, σ \sigma σ叫做总体标准偏差(Population Standard Deviation),而 S S S叫做样本标准偏差(Sample Standard Deviation),是两种不同的标准偏差。它们的区别何在?总体标准偏差就是你已经知道了所有的数据,比如班级的成绩,然后你要计算它的离散程度。这在物理测量当中是不可能出现的,因为你可以测量无限次。样本标准偏差就是你要用一些数据(样本)来估计整体情况,相当于以偏概全。物理实验中就是这样一种情况,你测得一组数据,然后用这组数据近似表示真实值。在这种情形下,如果我们测得一组数据 x 1 , x 2 , ⋯ , x n x_1,x_2,\cdots,x_n x1,x2,⋯,xn,用总体标准偏差 σ \sigma σ来表征离散程度的话,就出现问题了:总体平均值,也就是真实值 μ \mu μ,我们是不知道的。那我们用 x ˉ \bar x xˉ代替 μ \mu μ,就会导致:我们计算的是 x 1 , x 2 , ⋯ , x n x_1,x_2,\cdots,x_n x1,x2,⋯,xn围绕样本的平均值 x ˉ \bar x xˉ的离散程度,而不是围绕真实值 μ \mu μ的离散程度。对于一组数 x 1 , x 2 , ⋯ , x n x_1,x_2,\cdots,x_n x1,x2,⋯,xn和一个变量 t t t,令 f ( t ) = ∑ i = 1 n ( x i − t ) 2 f(t)=\sum\limits_{i=1}^n(x_i-t)^2 f(t)=i=1∑n(xi−t)2,这是一个开口向上的二次函数,在 t = − b 2 a = ∑ i = 1 n 2 x i 2 n = ∑ i = 1 n x i n = x ˉ t=-\frac{b}{2a}=\frac{\sum\limits_{i=1}^n2x_i}{2n}=\frac{\sum\limits_{i=1}^nx_i}{n}=\bar x t=−2ab=2ni=1∑n2xi=ni=1∑nxi=xˉ的时候取得最小值。也就是说, ∑ i = 1 n ( x i − x ˉ ) 2 ≤ ∑ i = 1 n ( x i − μ ) 2 \sum\limits_{i=1}^n(x_i-\bar x)^2\le\sum\limits_{i=1}^n(x_i-\mu)^2 i=1∑n(xi−xˉ)2≤i=1∑n(xi−μ)2。这就意味着,我们低估了数据的离散程度。我们需要将分母改为 n − 1 n-1 n−1,来稍稍增大偏差的值。

那为什么是 n − 1 n-1 n−1呢?纯统计学的严格证明颇为复杂,但我们可以用一种别样的思考方式。现在我们获得的样本有 n n n个测量结果,就是有 n n n条独立的信息。我们已经知道 x ˉ \bar x xˉ,如果再知道 x 1 − x ˉ , x 2 − x ˉ , ⋯ , x n − 1 − x ˉ x_1-\bar x,x_2-\bar x,\cdots,x_{n-1}-\bar x x1−xˉ,x2−xˉ,⋯,xn−1−xˉ,那 x n − x ˉ x_n-\bar x xn−xˉ自然就知道了。现在我们把这些偏差的平方加起来,应该只有 n − 1 n-1 n−1条独立的信息,所有除以 n − 1 n-1 n−1才说得通。专业的名词叫做有 n − 1 n-1 n−1个“自由度”。

其实到这里你也许还是没有理解。是的,我也没有理解。在系统学习统计学之前是不可能理解的。但是很多人对采用 n − 1 n-1 n−1作为分母的说法是“约定俗成的”,即用 n − 1 n-1 n−1更符合统计规律。所以我们也不用在乎那么多了,记住在物理实验的时候用 n − 1 n-1 n−1作为分母来算标准偏差就好了。

最后,我想说的是,当 n → ∞ n\to\infty n→∞的时候,即测量无限次,那 x ˉ \bar x xˉ就是 μ \mu μ, σ \sigma σ和 S S S的比值就会趋近于 1 1 1,这时总体标准偏差和样本标准偏差就是一回事了。

二、标准偏差和标准误

还是讨论物理实验中的问题。我们刚才讲了标准偏差(Standard Deviation),它的公式是 S = ∑ i = 1 n ( x i − x ˉ ) 2 n − 1 S=\sqrt{\frac{\sum_{i=1}^{n}(x_i-\bar x)^2}{n-1}} S=n−1∑i=1n(xi−xˉ)2关于分母为什么是 n − 1 n-1 n−1就已经够让我们头疼了,现在又冒出来一个标准误(Standard Error of Mean),这玩意又是什么呢?

标准误的含义用来估计样本平均值和真实值有多少差异的,用 σ x ˉ \sigma_{\bar x} σxˉ表示。例如, x ˉ = 0.370 \bar x=0.370 xˉ=0.370, σ x ˉ = 0.002 \sigma_{\bar x}=0.002 σxˉ=0.002,那么测量结果就写成 0.370 ± 0.002 0.370\pm0.002 0.370±0.002。

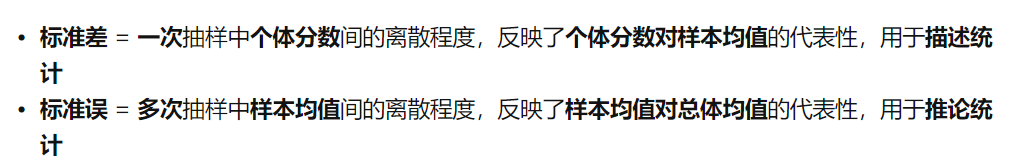

对于标准偏差和标准误的区别,知乎上有一个我感觉很好的解释:

举个栗子,现在我们测量了 200 200 200次,分为 20 20 20组,每组 10 10 10个数取一个平均值,那这 20 20 20个平均值的标准偏差就是这 200 200 200个数据的标准误。

标准误的计算公式是 σ x ˉ = S n = ∑ i = 1 n ( x i − x ˉ ) 2 n ( n − 1 ) \sigma_{\bar x}=\frac{S}{\sqrt n}=\sqrt{\frac{\sum_{i=1}^{n}(x_i-\bar x)^2}{n(n-1)}} σxˉ=nS=n(n−1)∑i=1n(xi−xˉ)2

为什么要除以 n \sqrt n n呢?我们考虑 n x ˉ = x 1 , x 2 ⋯ , x n n\bar x=x_1,x_2\cdots,x_n nxˉ=x1,x2⋯,xn的标准偏差,而 x 1 , x 2 ⋯ , x n x_1,x_2\cdots,x_n x1,x2⋯,xn是相互独立的,所以它们的标准偏差都等于 S S S,其中 S S S是 x x x的标准偏差。那么 σ n x ˉ 2 = n S 2 \sigma_{n\bar x}^2=nS^2 σnxˉ2=nS2,即 n 2 σ x ˉ 2 = n S 2 n^2\sigma_{\bar x}^2=nS^2 n2σxˉ2=nS2, σ x ˉ = S n \sigma_{\bar x}=\frac{S}{\sqrt n} σxˉ=nS。

本文到这里就结束了,还是留下了太多没有解决的问题,以后慢慢补上吧,总之物理实验直接套公式就行了,不用操那么多心~

2022/11/28更新:现在学了概率论与数理统计,有了新的理解,请看这里–>【概率论】关于为什么样本标准偏差分母是n-1的进一步理解。

今天的文章标准差是标准误差还是标准偏差_标准偏差和标准误差有什么区别「建议收藏」分享到此就结束了,感谢您的阅读。

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容, 请发送邮件至 举报,一经查实,本站将立刻删除。

如需转载请保留出处:https://bianchenghao.cn/88442.html