目前使用较多的网络插件有 flannel,calico,canel等,但是如果对比以上几种网络插件的性能,还是calico最受欢迎

一、calico概述

二、性能评测指标

三、物理机性能评测

四、物理机到pod之间的性能测评

五、pod到pod之间的性能测评

六、calico使用ipip网络模式

七、calico使用bgp网络模式

一、calico概述

1.calico介绍

Calico是一个纯三层的网络插件,calico的bgp模式类似于flannel的host-gw

calico方便集成 OpenStack这种 IaaS云架构,为openstack虚拟机、容器、裸机提供多主机间通信。

2.calico原理

calico是一个纯三层的虚拟网络,它没有复用docker的docker0网桥,而是自己实现的, calico网络不对数据包进行额外封装,不需要NAT和端口映射,扩展性和性能都很好。Calico网络提供了DockerDNS服务, 容器之间可以通过hostname访问,Calico在每一个计算节点利用LinuxKernel实现了一个高效的vRouter(虚拟路由)来负责数据转发,它会为每个容器分配一个ip,每个节点都是路由,把不同host的容器连接起来,从而实现跨主机间容器通信。而每个vRouter通过BGP协议(边界网关协议)负责把自己节点的路由信息向整个Calico网络内传播——小规模部署可以直接互联,大规模下可通过指定的BGProute reflector来完成;Calico基于iptables还提供了丰富而灵活的网络策略,保证通过各个节点上的ACLs来提供多租户隔离、安全组以及其他可达性限制等功能。

3.calico网络模式

1)IPIP

把一个IP数据包又套在一个IP包里,即把IP层封装到IP层的一个 tunnel,它的作用其实基本上就相当于一个基于IP层的网桥,一般来说,普通的网桥是基于mac层的,根本不需要IP,而这个ipip则是通过两端的路由做一个tunnel,把两个本来不通的网络通过点对点连接起来;

calico以ipip模式部署完毕后,node上会有一个tunl0的网卡设备,这是ipip做隧道封装用的,也是一种overlay模式的网络。当我们把节点下线,calico容器都停止后,这个设备依然还在,执行 rmmodipip命令可以将它删除。

2)BGP

边界网关协议(BorderGateway Protocol, BGP)是互联网上一个核心的去中心化的自治路由协议。它通过维护IP路由表或‘前缀’表来实现自治系统(AS)之间的可达性,属于矢量路由协议。BGP不使用传统的内部网关协议(IGP)的指标,而是基于路径、网络策略或规则集来决定路由。因此,它更适合被称为矢量性协议,而不是路由协议,通俗的说就是将接入到机房的多条线路(如电信、联通、移动等)融合为一体,实现多线单IP;

BGP 机房的优点:服务器只需要设置一个IP地址,最佳访问路由是由网络上的骨干路由器根据路由跳数与其它技术指标来确定的,不会占用服务器的任何系统;

官方提供的calico.yaml模板里,默认打开了ip-ip功能,该功能会在node上创建一个设备tunl0,容器的网络数据会经过该设备被封装一个ip头再转发。这里,calico.yaml中通过修改calico-node的环境变量:CALICO_IPV4POOL_IPIP来实现ipip功能的开关:默认是Always,表示开启;Off表示关闭ipip。

二、性能评测指标

1.ping延迟: 用ping测试hosts之间和pods之间的延迟

2.带宽测试: 用iperf测试hosts之间和pods之间的带宽

3.HTTP性能测试: 部署单进程nginx server并使用apache benchmark(ab)测试

三、物理机性能评测

1.ping延迟:

登录到master1节点,运行ping master2 测试延迟

通过下面的脚本例子计算ping延迟的平均值

|

1 |

|

结论:相互之间多次ping测试。延迟一般在60-64ms

2.iperf带宽:

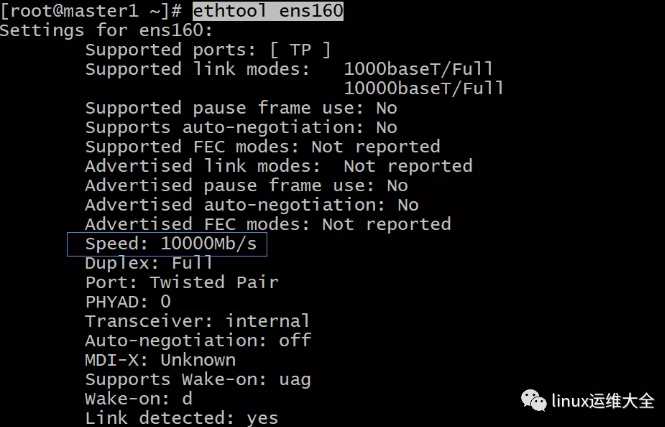

(1)查看物理机带宽

登录到master1节点

ethtool ens160

上面可以看到物理机带宽为万兆

(2)用iperf开始测试带宽

登陆到master1和master2节点,安装iperf,yum install iperf -y

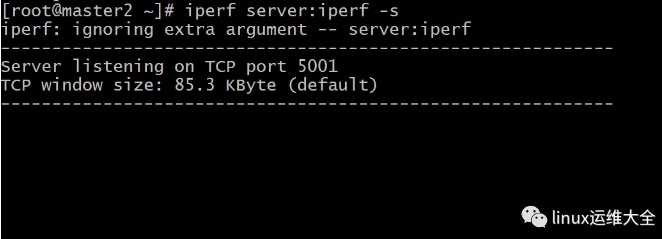

在master2上启动iperf服务

iperf server:iperf -s 显示如下:

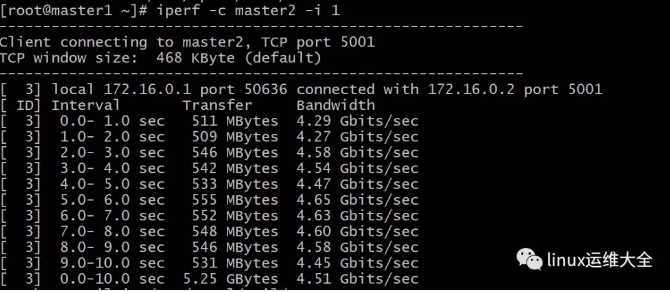

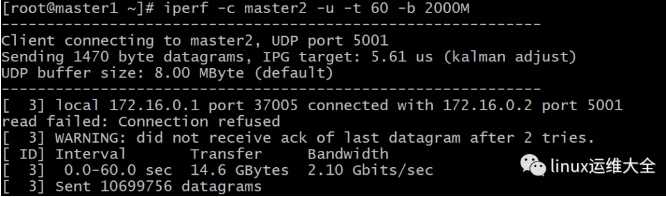

在master1上启动客户端命令:

iperf -c master2 -i 1

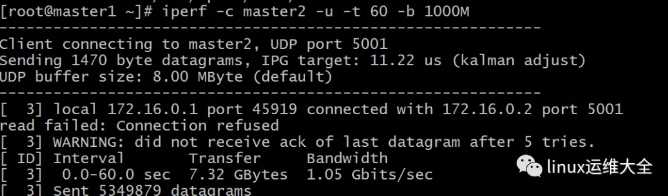

iperf -c master2 -u -t 60 -b 1000M

iperf -c master2 -u -t 60 -b 2000M

结论:物理机iperf带宽4.51 Gbits/sec

3.nginx benchmark

在master1节点运行一个nginx的pod

docker run –name nginx-test -p 8050:80 nginx

在master2节点通过ab进行压测

|

1 |

|

四、物理机到pod之间的性能测评

1.带宽

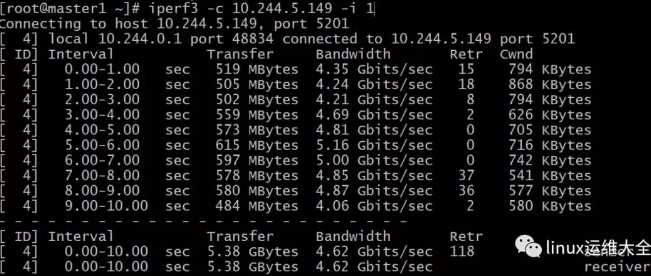

测试master1到node3节点上的pod之间的带宽

运行一个iperf3的pod

kubectl run iperf3 –image=networkstatic/iperf3 –replicas=3 — iperf3 -s

kubectl get pods -o wide

iperf3 -c 10.244.5.149 -i 1

结论:master1和node3上的pod之间的带宽是4.06Gbits/s

五、pod到pod之间的性能测评

1.带宽

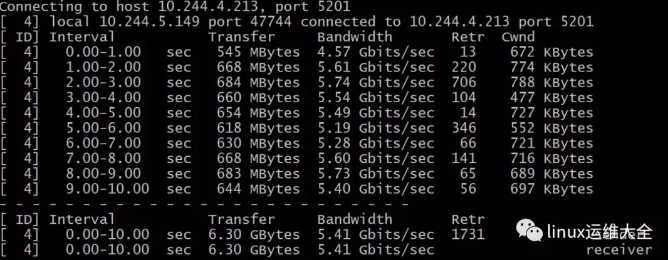

测试node3上的pod到node2上的pod的带宽

登录到node3上的pod

kubectl exec -it iperf3-57d88c87b4-89kxw — /bin/sh

iperf3 -c 10.244.4.213 -i 1

结论:node3上的pod和node2上的pod之间的带宽是5.40Gbits/s

六、calico使用ipip网络模式

1.测试带宽,测试10次取平均值:

(1) 物理机到物理机/master1——>master2

在master2上 iperf3 -s

在master1上执行测试脚本:

|

1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 |

|

结论:

sender Avg= 5.07

receiver Avg= 5.068

(2)物理机到pod/master1——>node3上的pod(pod:iperf3-57d88c87b4-89kxw ip:10.244.5.149)

在master1上执行测试脚本:

|

1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 |

|

结论:

sender Avg= 4.436

receiver Avg= 4.435

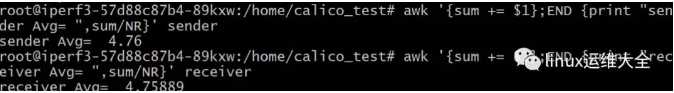

(3).pod到pod/node3节点pod((pod:iperf3-57d88c87b4-89kxw ip:10.244.5.149))——>node2上的pod(pod:iperf3-57d88c87b4-fmkcj ip:10.244.4.213 )

在node3的pod上执行测试脚本:

kubectl exec -it iperf3-57d88c87b4-89kxw — /bin/sh

|

1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 |

|

结论:

sender Avg= 4.76

receiver Avg= 4.75889

2.测试ping延时,测试20次取平均值:

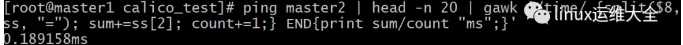

(1).物理机到物理机/master1——>master2

登录到master1节点,运行ping master2 测试延时

通过下面的脚本例子计算ping延迟的平均值

ping master2 | head -n 20 | gawk ‘/time/ {split($8, ss, “=”); sum+=ss[2]; count+=1;} END{print sum/count “ms”;}’

结论:多次ping取平均值,延迟一般在0.189158ms

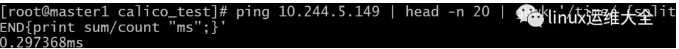

(2).物理机到pod/master1——>node3上的pod(pod:iperf3-57d88c87b4-89kxw ip:10.244.5.149)

ping 10.244.5.149 | head -n 20 | gawk ‘/time/ {split($7, ss, “=”); sum+=ss[2]; count+=1;} END{print sum/count “ms”;}’

结论:多次ping取平均值,延迟一般在0.297368ms

(3).pod到pod/node3节点pod((pod:iperf3-57d88c87b4-89kxw ip:10.244.5.149))——>node2上的pod(pod:iperf3-57d88c87b4-fmkcj ip:10.244.4.213 )

kubectl exec -it iperf3-57d88c87b4-89kxw — /bin/bash

ping 10.244.4.213 | head -n 20 | awk ‘/time/ {split($7, ss, “=”); sum+=ss[2]; count+=1;} END{print sum/count “ms”;}’

结论:多次ping取平均值,延迟一般在0.312ms

七、calico使用bgp网络模式

1.测试带宽,测试10次取平均值:

(1).物理机到物理机/master1——>master2

在master2上 iperf3 -s

在master1上执行测试脚本:

|

1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 |

|

结论:

sender Avg= 5.081

receiver Avg= 5.079

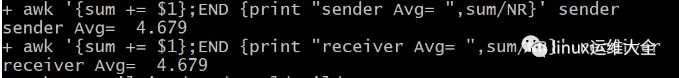

(2).物理机到pod/master1——>node3上的pod(pod:iperf3-57d88c87b4-wbpqn ip:10.244.5.156)

在master1上执行测试脚本:

|

1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 |

|

结论:

sender Avg= 4.679

receiver Avg= 4.679

(3).pod—>pod

结论:跨节点pod之间不能通信

2.测试ping延时,测试20次取平均值:

(1).物理机到物理机/master1——>master2

登录到master1节点,运行ping master2 测试延时

通过下面的脚本例子计算ping延迟的平均值

ping master2 | head -n 20 | gawk ‘/time/ {split($8, ss, “=”); sum+=ss[2]; count+=1;} END{print sum/count “ms”;}’

结论:多次ping取平均值,延迟一般在0.188842ms

(2).物理机到pod/master1——>node3上的pod(pod:iperf3-57d88c87b4-wbpqn ip:10.244.5.156)

ping 10.244.5.156 | head -n 20 | gawk ‘/time/ {split($7, ss, “=”); sum+=ss[2]; count+=1;} END{print sum/count “ms”;}’

结论:多次ping取平均值,延迟一般在0.268053ms

(3).pod到pod节点

结论:跨节点pod之间不能通信

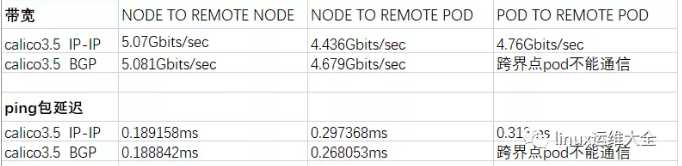

上述两种网络模式网络性能总结表

结论:

calico使用BGP网络模式通信网络传输速率较好,但是跨节点后pod不能通信。

今天的文章bgp iplc_bgp配置实例「建议收藏」分享到此就结束了,感谢您的阅读。

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容, 请发送邮件至 举报,一经查实,本站将立刻删除。

如需转载请保留出处:https://bianchenghao.cn/84779.html