文章目录

0. Write behind

本篇文章也是关于VAE的深度无监督聚类算法VaDE,主要从它的模型、Loss、优化方法去讲、最后会简单提及实验部分,并且与之前的GMVAE作比较。

1. Abstract

- 提出VaDE模型,它是深度无监督聚类生成模型,结合了VAE和GMM。

- 指出数据的生成过程:

1.从GMM分布中选择一个簇

2.从这个簇中产生一个隐变量z

3.解码该隐变量z生成观测数据 - 提出用SVGB优化方法

- 实验效果很好

1. Introduction(介绍)

- 这一部分一般是概要性的引出作者提出的模型,我们直接上模型。

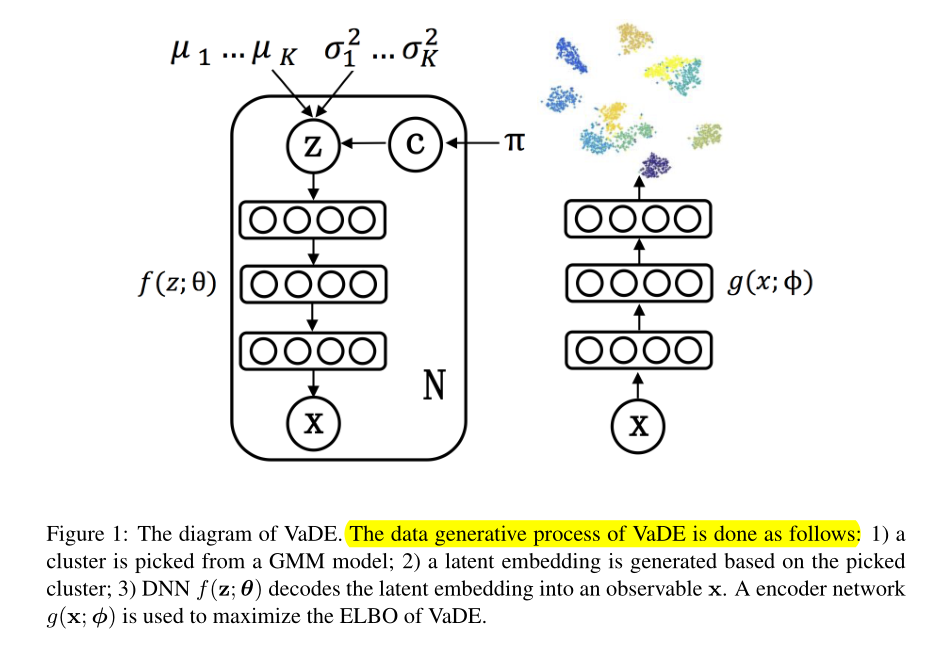

- 下图为VaDE的图解,左边是模型的生成过程,右边是模型的推理过程

- 在这一部分,文中还说到DEC模型的缺陷:DEC模型没有数据生成的过程,所以不能产生图片,因为它使用的是Autoencoder

2. Related work

- 这一部分主要是写前人的一些研究工作并说出它们的不足,最后再引出自己的模型,并说说自己模型的优点,不再介绍。

3. Variational Deep Embedding(VaDE)

这一部分作者详细阐述了VaDE模型,包括生成模型和推理模型

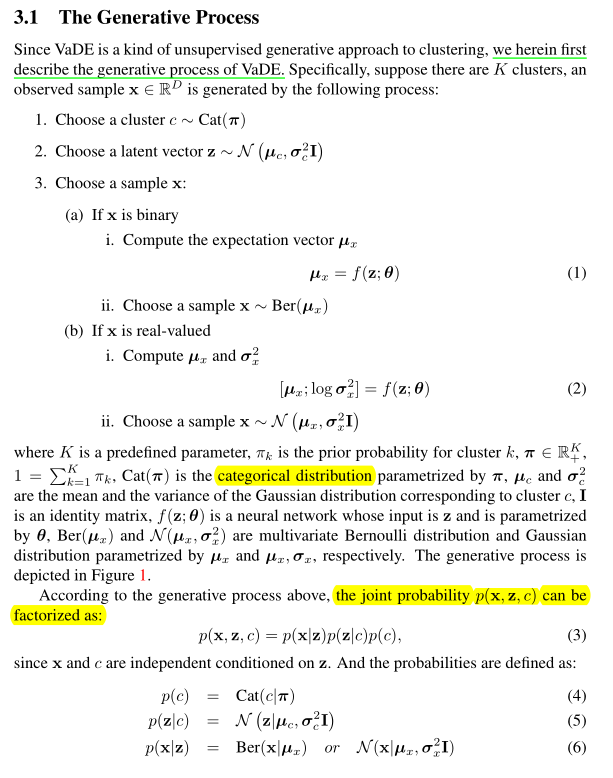

3.1 Generative Model

3.2 Inference Model

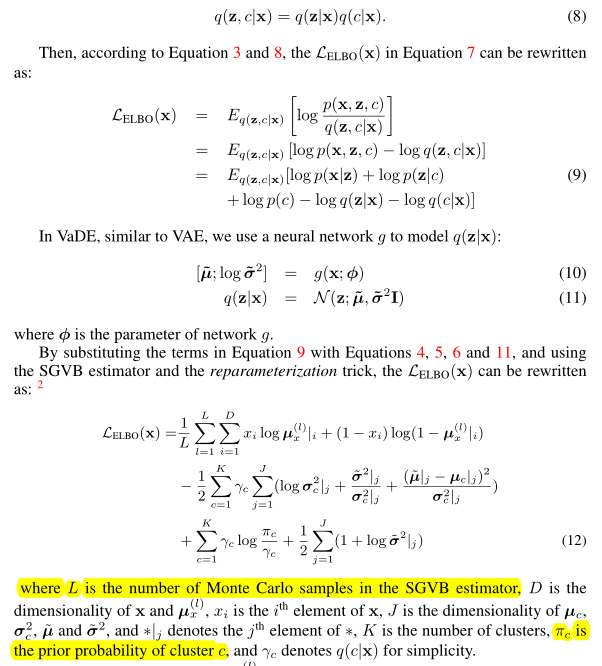

- 推理模型为公式(8):q(z,c|x)=q(z|x)q(c|x),用来优化我们的变分下界的

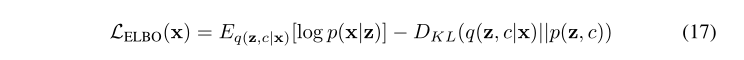

- 公式(9)给出了变分下届,公式(12)给出了近似解(编程时用),其中的数学推导很复杂,这篇paper再最后给出了详细的证明,有兴趣可以自己下载下来看看,这里不再赘述。

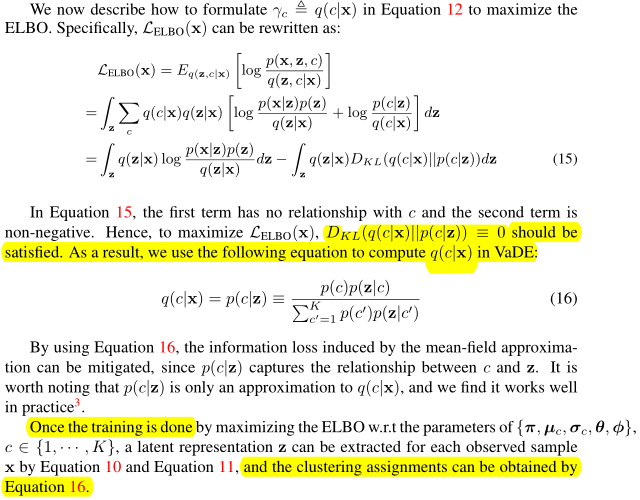

- 公式(16)给出了一个优化trick,也是详细证明的。公式(16)表示的是GMM中的响应度,GMM就是靠这个来聚类的。

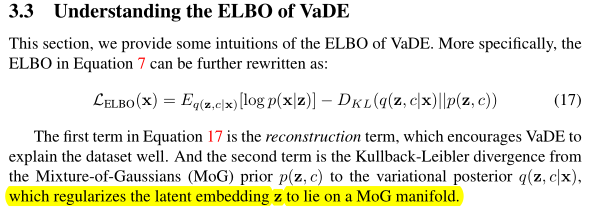

3.3 Understanding the ELBO of VaDE

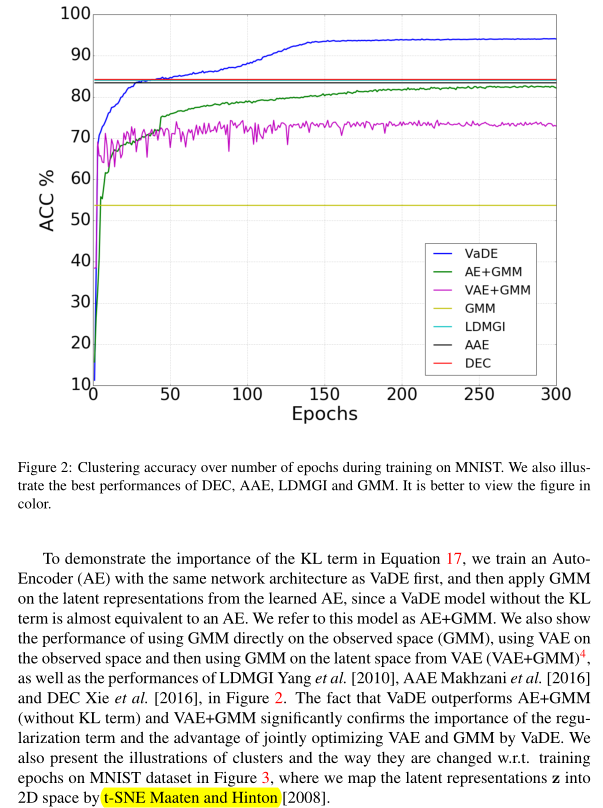

4. Experiments

- 关于实验这块,不想讲太多,主要了了几个细节

4.1 Net Structure

推理网络:D-500-500-2000-10(FC)

生成网络:10-2000-500-500-D(FC)

优化器:ADAM

BATCH_SIZE:100

GMM的参数是经过预先初始化的,然后放入到网络中训练,根据GMM模型可知,网络收敛不到全局最优,只能收敛到局部最优甚至更糟糕

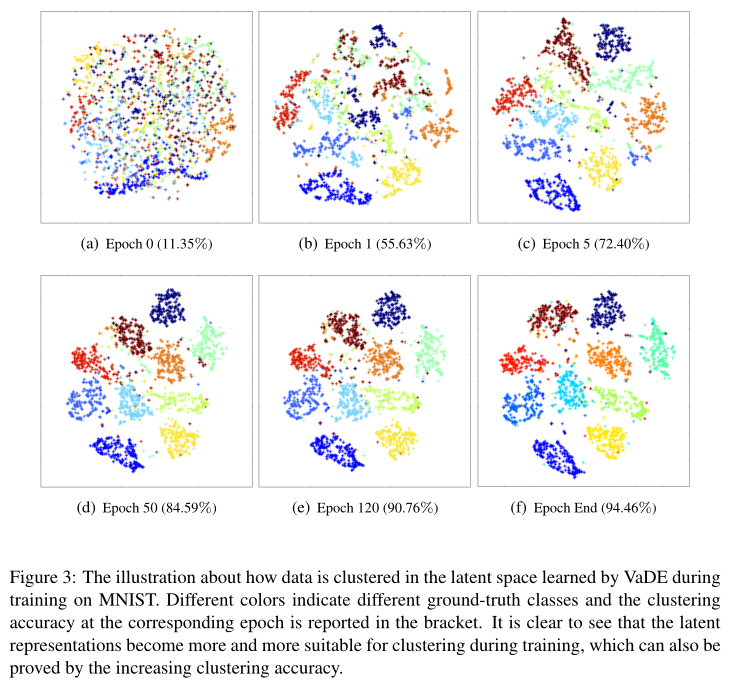

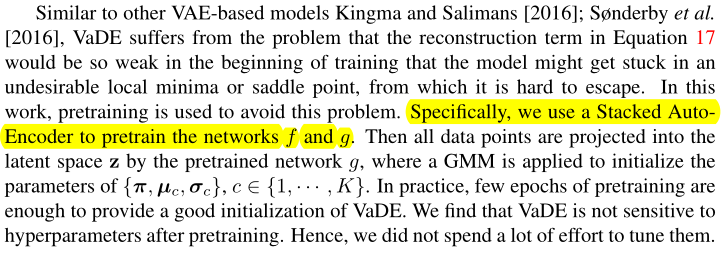

4.2 Pre-training(figure out over-regularisation problem)

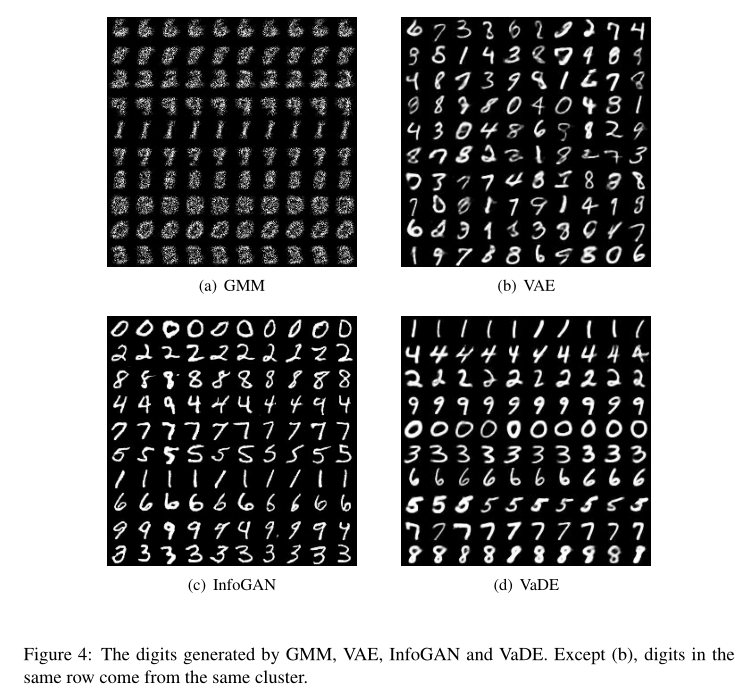

4.3 Sample from different components of GMM

5. 与GMVAE的区别

GMVAE

1.推理模型和生成模型不一样

2.计算准确率的方式不一样

3.处理over-regularisation问题的方式不一样

今天的文章Variational Deep Embedding: An Unsupervised and Generative Approach to Clustering(VaDE)分享到此就结束了,感谢您的阅读。

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容, 请发送邮件至 举报,一经查实,本站将立刻删除。

如需转载请保留出处:https://bianchenghao.cn/88642.html